A falha de IA mais cara que já vi em implantações empresariais não produziu erro. Nenhum alerta foi disparado. Nenhum painel ficou vermelho. O sistema estava totalmente operacional, mas estava errado de forma consistente e segura. Essa é a lacuna de confiabilidade. E é o problema que a maioria dos programas empresariais de IA não foi criada para resolver.

Passamos os últimos dois anos nos tornando muito bons na avaliação de modelos: benchmarks, pontuações de precisão, exercícios de equipe vermelha, testes de qualidade de recuperação. Mas na produção, o modelo raramente está onde o sistema quebra. Ele quebra a camada de infraestrutura, os pipelines de dados que o alimentam, a lógica de orquestração que o envolve, os sistemas de recuperação que o fundamentam, os fluxos de trabalho downstream que confiam em sua saída. Essa camada ainda está sendo monitorada com ferramentas projetadas para um tipo diferente de software program.

A lacuna que ninguém está medindo

Aqui está o que torna esse problema difícil de ver: operacionalmente saudável e comportamentalmente confiável não são a mesma coisa, e a maioria das pilhas de monitoramento não consegue perceber a diferença.

Um sistema pode mostrar verde em todas as métricas de infraestrutura, latência dentro do SLA, taxa de transferência regular, taxa de erro plana, enquanto raciocina simultaneamente sobre resultados de recuperação que estão obsoletos há seis meses, retornando silenciosamente ao contexto em cache após a degradação de uma chamada de ferramenta ou propagando uma interpretação incorreta por meio de cinco etapas de um fluxo de trabalho de agente. Nada disso aparece em Prometheus. Nada disso dispara um alerta Datadog.

A razão é simples: a observabilidade tradicional foi construída para responder à pergunta “o serviço está funcionando?” A IA empresarial exige responder a uma pergunta mais difícil: “O serviço está se comportando corretamente?” São instrumentos diferentes.

|

O que as equipes normalmente medem |

O que realmente leva à falha da infraestrutura de IA |

|

Tempo de atividade/latência/taxa de erro |

Frescor de recuperação e confiança de aterramento |

|

Uso de token |

Integridade de contexto em fluxos de trabalho de várias etapas |

|

Taxa de transferência |

Desvio semântico sob carga do mundo actual |

|

Pontuações de benchmark do modelo |

Consistência comportamental quando as condições se degradam |

|

Taxa de erro de infraestrutura |

Falha parcial silenciosa na camada de raciocínio |

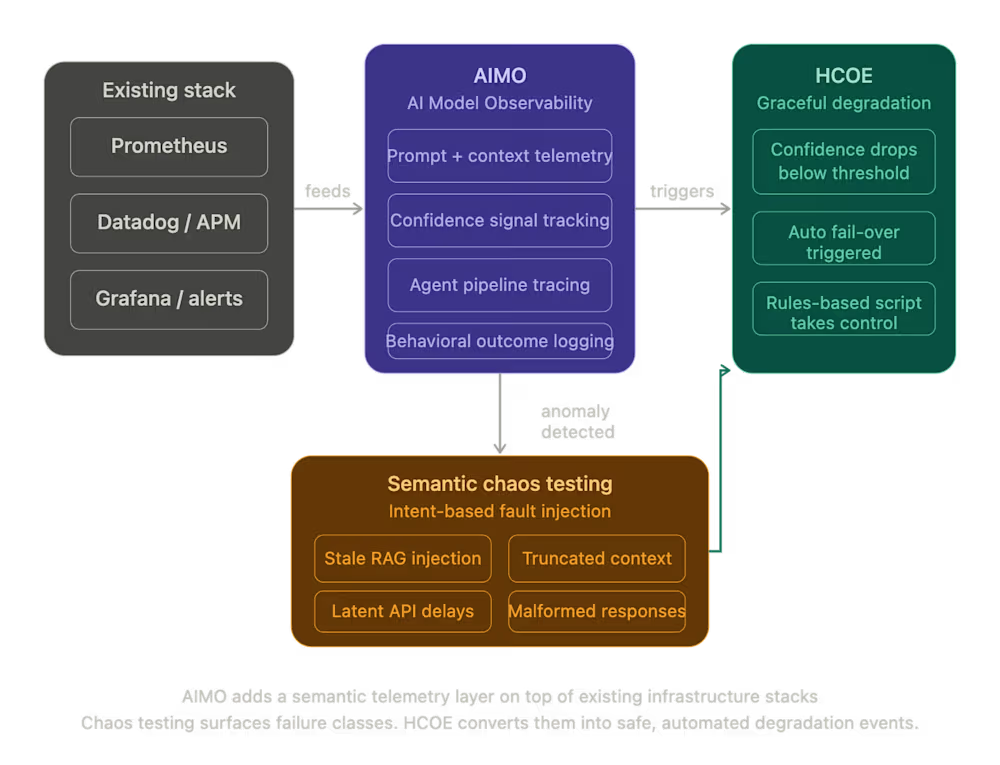

Colmatar esta lacuna requer a adição de uma camada de telemetria comportamental juntamente com a de infraestrutura – não substituindo o que existe, mas alargando-a para capturar o que o modelo realmente fez com o contexto que recebeu, e não apenas se o serviço respondeu.

Quatro padrões de falha que o monitoramento padrão não detectará

Nas implantações empresariais de IA em operações de rede, logística e plataformas de observabilidade, vejo quatro padrões de falha se repetindo com consistência suficiente para nomeá-los.

O primeiro é a degradação do contexto. O modelo raciocina sobre dados incompletos ou obsoletos de uma forma invisível para o usuário ultimate. A resposta parece polida. O aterramento desapareceu. A detecção geralmente acontece semanas depois, por meio de consequências posteriores, em vez de alertas do sistema.

O segundo é o desvio de orquestração. Os pipelines agentes raramente falham porque um componente quebra. Eles falham porque a sequência de interações entre recuperação, inferência, uso de ferramentas e ação posterior começa a divergir sob carga do mundo actual. Um sistema que parecia estável nos testes se comporta de maneira muito diferente quando a latência aumenta nas etapas e na pilha de casos extremos.

A terceira é uma falha parcial silenciosa. Um componente apresenta desempenho inferior sem ultrapassar o limite de alerta. O sistema degrada comportamentalmente antes de degradar operacionalmente. Essas falhas se acumulam silenciosamente e aparecem primeiro como desconfiança do usuário, e não como tickets de incidente. No momento em que o sinal chega à autópsia, a erosão já ocorre há semanas.

O quarto é o raio de explosão da automação. No software program tradicional, um defeito localizado permanece native. Em fluxos de trabalho orientados por IA, uma interpretação errada no início da cadeia pode se propagar pelas etapas, sistemas e decisões de negócios. O custo não é apenas técnico. Torna-se organizacional e é muito difícil reverter.

As métricas informam o que aconteceu. Eles raramente contam o que quase aconteceu.

Por que a engenharia clássica do caos não é suficiente e o que precisa mudar

A engenharia do caos tradicional faz o tipo certo de pergunta: o que acontece quando as coisas quebram? Mate um nó. Elimine uma partição. Espiga CPU. Observar. Esses testes são necessários e as empresas devem realizá-los.

Mas para os sistemas de IA, as falhas mais perigosas não são causadas por falhas graves na infraestrutura. Eles emergem na camada de interação entre qualidade de dados, montagem de contexto, raciocínio de modelo, lógica de orquestração e ação posterior. Você pode sobrecarregar a infraestrutura o dia todo e nunca revelar o modo de falha que mais lhe custa.

O que os testes de confiabilidade de IA precisam é de uma camada baseada em intenção: definir o que o sistema deve fazer em condições degradadas, e não apenas o que deve fazer quando tudo funciona. Em seguida, teste as condições específicas que desafiam essa intenção. O que acontece se a camada de recuperação retornar conteúdo tecnicamente válido, mas desatualizado há seis meses? O que acontece se um agente de sumarização perder 30% de sua janela de contexto devido à inflação simbólica inesperada no upstream? O que acontece se uma chamada de ferramenta for bem-sucedida sintaticamente, mas retornar dados semanticamente incompletos? O que acontece se um agente tentar novamente através de um fluxo de trabalho degradado e acumular seu próprio erro em cada etapa?

Esses cenários não são casos extremos. Eles são a aparência da produção. Esta é a estrutura que apliquei na construção de sistemas de confiabilidade para infraestrutura corporativa: criação de nível de caos baseado em intenção para ambientes de computação distribuídos. O perception principal: a intenção outline o teste, não apenas a falha.

O que a camada de infraestrutura realmente precisa

Nada disso exige a reinvenção da pilha. Requer estender quatro coisas.

Adicione telemetria comportamental juntamente com telemetria de infraestrutura. Acompanhe se as respostas foram fundamentadas, se o comportamento de reserva foi desencadeado, se a confiança caiu abaixo de um limite significativo, se o resultado foi apropriado para o contexto posterior em que entrou. Esta é a camada de observabilidade que torna todo o resto interpretável.

Introduza a injeção semântica de falhas em ambientes de pré-produção. Simule deliberadamente recuperação obsoleta, montagem de contexto incompleta, degradação de chamada de ferramenta e pressão no limite do token. O objetivo não é o caos teatral. O objetivo é descobrir como o sistema se comporta quando as condições são um pouco piores do que o seu ambiente de teste – que é sempre o que é a produção.

Defina condições de parada segura antes da implantação, não após o primeiro incidente. Os sistemas de IA precisam do equivalente a disjuntores na camada de raciocínio. Se um sistema não puder manter o aterramento, validar a integridade do contexto ou concluir um fluxo de trabalho com confiança suficiente para ser confiável, ele deverá parar de forma limpa, rotular a falha e entregar o controle a um humano ou a um substituto determinístico. Uma parada graciosa é quase sempre mais segura do que um erro fluente. Muitos sistemas são projetados para continuar funcionando porque resultados confiantes criam a ilusão de correção.

Atribua propriedade compartilhada para confiabilidade de ponta a ponta. A falha organizacional mais comum é uma separação clara entre equipes de modelo, equipes de plataforma, equipes de dados e equipes de aplicativos. Quando o sistema está operacionalmente funcionando, mas comportamentalmente errado, ninguém o possui claramente. A falha semântica precisa de um dono. Sem ele, ele se acumula.

A curva de maturidade está mudando

Nos últimos dois anos, o diferencial da IA empresarial tem sido a adoção — quem chega à produção mais rápido. Essa fase está terminando. À medida que os modelos se tornam comoditizados e a capacidade de base converge, a vantagem competitiva virá de algo mais difícil de copiar: a capacidade de operar a IA de forma fiável em escala, em condições reais, com consequências reais.

O diferencial de ontem foi a adoção do modelo. A de hoje é a integração de sistemas. Amanhã será a confiabilidade sob estresse de produção.

As empresas que chegarem lá primeiro não terão os modelos mais avançados. Terão à sua volta a infra-estrutura mais disciplinada – infra-estrutura que foi testada face às condições que realmente enfrentaria, e não às condições que fizeram o piloto parecer bom.

O modelo não é todo o risco. O sistema não testado em torno disso é.

Sayali Patil é líder de produtos e infraestrutura de IA.

Bem-vindo à comunidade VentureBeat!

Nosso programa de visitor posts é onde especialistas técnicos compartilham insights e fornecem análises profundas, neutras e não adquiridas, sobre IA, infraestrutura de dados, segurança cibernética e outras tecnologias de ponta que moldam o futuro das empresas.

Leia mais do nosso programa de visitor submit – e confira nosso diretrizes se você estiver interessado em contribuir com um artigo de sua autoria!