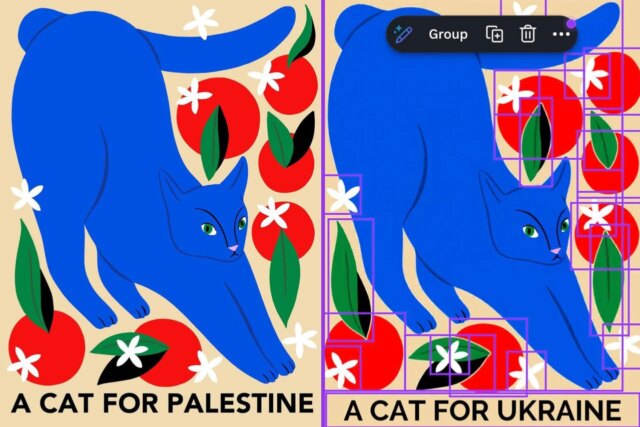

A plataforma de design gráfico Canva tem uma série de ferramentas de IA disponíveis para os usuários, mas acontece que eles têm opiniões editoriais realmente fortes – incluindo a remoção da palavra “Palestina” dos designs. A questão foi descoberto pelo usuário X @ros_ie9que compartilhou uma imagem mostrando o recurso “Magic Layers” do Canva alterando o texto de um design de “Gatos para a Palestina” para “Gatos para a Ucrânia”.

Outros afirmaram que eram capazes de replicar o problemaque parecia limitada à palavra “Palestina” e, por alguma razão, substituiu-a repetidamente por “Ucrânia”. Os usuários puderam criar projetos que incluíam a palavra “Gaza” sem problemas.

Um porta-voz do Canva confirmou o problema quando contatado pelo Gizmodo e disse que foi resolvido. “Tomamos conhecimento de um problema com nosso recurso Magic Layers e agimos rapidamente para investigá-lo e corrigi-lo. Agora foi resolvido e estamos tomando medidas para garantir que isso não aconteça novamente”, explicou o porta-voz. “Levamos relatórios como este muito a sério e estamos implementando verificações adicionais para ajudar a evitar isso no futuro. Lamentamos qualquer sofrimento que isso possa ter causado.”

De acordo com o Canva, o problema foi isolado e não afetou os designs de forma ampla – embora não esteja claro o que isso significa, considerando que alguns usuários conseguiram reproduzir o problema. Independentemente disso, a empresa disse que lançou uma auditoria sobre como o problema surgiu e está revendo seus processos de testes internos para detectar e prevenir resultados inesperados no futuro.

O problema parece estar especificamente relacionado ao recurso Magic Layers do Canva, que introduzido no mês passado. A ferramenta alimentada por IA deve converter “imagens planas e saídas estáticas de IA em designs totalmente editáveis e multicamadas dentro do editor Canva”. Basicamente, é suposto fazer com que cada elemento de um design existente possa ser modificado, como se você o tivesse feito do zero. Por que tal recurso mudaria o texto de uma imagem por si só e sem qualquer instrução para fazê-lo permanece um mistério – embora possa nos dizer algo sobre os dados de treinamento e as instruções que a ferramenta recebeu.

Não é a primeira vez que as ferramentas de IA apresentam um preconceito em relação à Palestina. Quando a Meta introduziu ferramentas generativas de IA no WhatsApp, seria produzir uma imagem de um menino com uma arma quando solicitado a criar a imagem de um palestino. Em 2023, ativistas encontrados que o ChatGPT se recusou a responder afirmativamente quando questionado: “Os palestinos deveriam ser livres?” quando não teve problemas em responder a essa pergunta para qualquer outra população.