Atualmente, todos os laboratórios de IA de ponta estão racionando duas coisas: eletricidade e computação. A maioria deles compra seus computadores para treinamento de modelo do mesmo fornecedor, com margens brutas exorbitantes que transformaram a Nvidia em uma das empresas mais valiosas do mundo. O Google não.

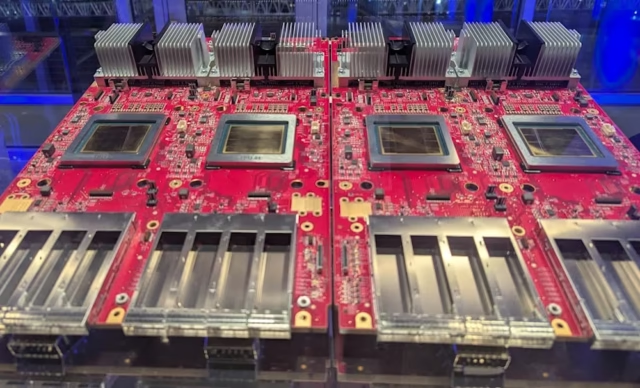

Na noite de terça-feira, em uma reunião privada no F1 Plaza em Las Vegas, o Google apresentou uma prévia de suas unidades de processamento tensor de oitava geração. A proposta: dois designs de silício personalizados lançados ainda este ano, cada um desenvolvido especificamente para uma metade diferente da carga de trabalho de IA moderna. A TPU 8t tem como alvo o treinamento para modelos de fronteira, e a TPU 8i tem como alvo o mundo de inferência de agentes e amostragem em tempo actual, de baixa latência e que consome muita memória.

Amin Vahdat, vice-presidente sênior do Google e tecnólogo-chefe de IA e infraestrutura (foto acima à esquerda), usou seu tempo no palco para defender um ponto que é mais importante para os compradores corporativos do que qualquer especificação particular person: o Google projeta cada camada de sua pilha de IA de ponta a ponta, e essa integração vertical está começando a aparecer na economia de custo por token que o Google diz que seus rivais não conseguem igualar.

“Um chip por ano não period suficiente”: Por dentro da aposta do Google para 2024 em um roteiro de dois chips

A história mais interessante por trás da v8t e da v8i é quando foi tomada a decisão de dividir o roteiro. A chamada ocorreu em 2024, de acordo com Vahdat – um ano antes de a indústria em geral se voltar para modelos de raciocínio, agentes e aprendizagem por reforço como carga de trabalho de fronteira dominante.

Na época, period uma leitura contrária. “Percebemos há dois anos que um chip por ano não seria suficiente”, disse Vahdat durante o serão. “Esta é a nossa primeira likelihood de realmente usar dois chips especializados de altíssima potência.”

Para os compradores empresariais, a implicação é concreta. Clientes que realizam treinamento de ajuste fino ou em larga escala no Google Cloud e clientes que atendem agentes de produção no Vértice AI tenho alugado os mesmos aceleradores e comido a ineficiência. V8 é a primeira geração em que o próprio silício trata esses problemas como diferentes com dois conjuntos de chips.

TPU 8t: uma estrutura de treinamento que pode chegar a um milhão de chips

No papel, o TPU 8t é um passo geracional agressivo. De acordo com o Google, 8t oferece 2,8x os EFlops FP4 por pod (121 vs 42,5) em relação ao Ironwood, o TPU de sétima geração lançado em 2025, dobra a largura de banda de expansão bidirecional para 19,2 Tb/s por chip e quadruplica a rede de expansão para 400 Gb/s por chip. O tamanho do pod cresce modestamente de 9.216 para 9.600 chips, mantidos juntos pela topologia 3D Torus do Google.

O número que mais importa para os líderes de TI que avaliam onde realizar o treinamento em escala de fronteira: clusters de 8t (Superpods) podem escalar mais de 1 milhão de chips TPU em um único trabalho de treinamento por meio de uma nova interconexão que o Google está chamando de rede Virgo.

8t também introduz o TPU Direct Storage, que transfer dados do nível de armazenamento gerenciado do Google diretamente para o HBM sem os saltos habituais mediados pela CPU. Para longas execuções de treinamento em que o tempo do relógio é o fator de custo, o colapso desse caminho de dados reduz o número de horas de pod necessárias para terminar cada época.

TPU 8i e Boardfly: reengenharia da rede para agentes

Se o 8t é um passo evolutivo, o TPU 8i é o chip arquitetonicamente mais interessante. É também onde a história para os compradores de TI se torna mais convincente.

Os saltos nas especificações ano após ano são, como disse Vahdat, “impressionantes”. De acordo com o Google, o 8i oferece 9,8x os EFlops FP8 por pod (11,6 vs 1,2), 6,8x a capacidade HBM por pod (331,8 TB vs 49,2) e um tamanho de pod que cresce 4,5x de 256 para 1.152 chips.

O que impulsionou esses números foi repensar a própria rede. Vahdat explicou o perception diretamente: a maneira padrão do Google de conectar chips suportava largura de banda em vez de latência – boa para mover grandes quantidades de dados, não construída para o tempo mínimo que uma resposta leva para retornar. Esse perfil funciona para treinamento. Para os agentes, isso não acontece. Em parceria com o Google DeepMind, a equipe da TPU construiu o que o Google chama de topologia Boardfly especificamente para reduzir o diâmetro da rede – diminuindo o número de saltos entre quaisquer dois chips em um pod. Emparelhado com um mecanismo de aceleração coletiva e o que o Google descreve como SRAM on-chip muito grande, o 8i oferece uma melhoria de 5x na latência para amostragem LLM em tempo actual e aprendizado por reforço.

O fosso da integração vertical: por que o Google não paga o “imposto Nvidia”

O subtexto da apresentação de Vahdat foi um diagrama de seis camadas que o Google chama de pilha de IA: energia na base, depois terreno e gabinetes do information heart, {hardware} de infraestrutura de IA, software program de infraestrutura de IA, modelos (Gemini 3) e serviços no topo. Vahdat observou que projetar cada camada isoladamente força o mínimo denominador comum para cada camada. O Google os projeta juntos.

É aqui que se cristaliza a história competitiva para compradores e analistas de TI. OpenAI, Anthropic, xAI e Meta dependem fortemente do silício da Nvidia para treinar seus modelos de fronteira. Cada GPU H200 e Blackwell que eles compram traz consigo a margem bruta do information heart da Nvidia – o “imposto Nvidia” casual que os analistas do setor sinalizaram por dois anos consecutivos como uma desvantagem de custo estrutural para quem aluga em vez de projetar. O Google paga custos de fabricação, embalagem e engenharia em suas TPUs. Não paga essa margem.

O que a v8 significa para a corrida computacional: uma nova lista de verificação de avaliação para líderes de TI

Para as equipes de compras e infraestrutura, a TPUv8 reformula a avaliação da nuvem 2026–2027 de maneira concreta.

As equipes que treinam grandes modelos proprietários devem observar as janelas de disponibilidade de 8t, o acesso à rede Virgo e os SLAs de boa qualidade – e não apenas os EFlops principais. As equipes que atendem agentes ou cargas de trabalho de raciocínio devem avaliar a disponibilidade de 8i no Vertex AI, benchmarks de latência independentes à medida que surgem e se o dimensionamento de HBM por pod se ajusta às suas janelas de contexto. As equipes que consomem Gemini por meio do Gemini Enterprise devem herdar o elevador 8i e esperar que o limite máximo do que podem implantar na produção aumente significativamente até 2026.

As advertências são reais. A disponibilidade geral ainda é “no last de 2026”. A v8 é um sinal de roteiro, não uma decisão de aquisição hoje. Os benchmarks do Google são auto-relatados; sem dúvida, números independentes virão dos primeiros clientes da nuvem e de avaliadores terceirizados nos próximos dois trimestres. E a portabilidade entre JAX/XLA e o ecossistema CUDA/PyTorch continua sendo um custo de fricção que vale a pena considerar ao negociar qualquer compromisso plurianual.

Olhando mais além, Vahdat fez duas previsões dignas de nota. Primeiro, as CPUs de uso geral verão um ressurgimento dentro dos sistemas de IA – não como aceleradores, mas como computação de orquestração para sandboxes de agentes, máquinas virtuais e execução de ferramentas. Em segundo lugar, enquadrada explicitamente como uma previsão do setor, em vez de uma prévia do roteiro do Google, a especialização também continua forte. À medida que as CPUs de uso geral atingem um patamar de alguns por cento ao ano, as cargas de trabalho importantes exigirão silício desenvolvido especificamente. “Dois chips podem se tornar mais”, disse Vahdat – sem especificar se o “mais” significaria futuras variantes de TPU ou outras lessons de aceleradores especializados.

A corrida de fronteira da computação costumava ser uma questão de quem poderia comprar mais H100s. Agora é uma questão de quem controla a pilha. A lista de empresas que realmente o fazem é, no momento, duas: Google e Nvidia.