OpenAI tem lançou três novos modelos de áudio em sua API em tempo actual, e eles são um grande negócio para qualquer pessoa que crie aplicativos com tecnologia de voz. Os três modelos são GPT-Realtime-2, GPT-Realtime-Translate e GPT-Realtime-Whisper.

Juntos, eles movem a IA de voz além de simples respostas de ida e volta em direção a algo que pode entender você, agir e acompanhar uma conversa actual.

Se a demonstração deles servir de referência, acabamos de ver a próxima evolução na forma como os modelos de IA de voz funcionam.

Então, o que esses modelos podem realmente fazer?

GPT-Realtime-2 é a manchete. Ele traz raciocínio de classe GPT-5 para interações de voz ao vivo, o que significa que pode lidar com solicitações mais difíceis sem interromper a conversa.

Ele pode chamar diversas ferramentas simultaneamente e até mesmo narrar o que está fazendo com frases como “verificando sua agenda” ou “deixe-me dar uma olhada nisso”. Ele também possui uma janela de contexto maior de 128 mil tokens, o que significa sessões mais longas e coerentes. Os desenvolvedores podem até ajustar o esforço de raciocínio com base na complexidade da solicitação.

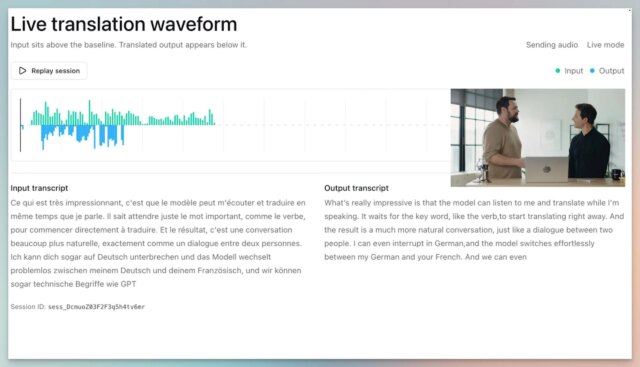

GPT-Realtime-Translate é provavelmente o meu favorito. É o mais próximo que chegamos de ter o Tradutor Common de Star Trek na vida actual. Ele suporta tradução de fala ao vivo em mais de 70 idiomas de entrada e 13 idiomas de saída.

A melhor parte da demonstração foi que mesmo quando uma nova pessoa entrou e falou um idioma diferente, o GPT-Realtime-Translate não teve problemas em traduzir ambos os falantes para o inglês em tempo actual.

Finalmente, há o GPT-Realtime-Whisper. A maioria dos modelos de fala para texto espera que o locutor termine antes de fornecer a tradução completa. Este é um modelo de transcrição de streaming que converte fala em texto enquanto o locutor fala. É útil para legendas ao vivo, notas de reuniões e qualquer fluxo de trabalho com tecnologia de voz em que esperar por uma transcrição não seja uma opção.

Alguém pode usar esses novos modelos de IA de voz?

Atualmente, a OpenAI lançou esses modelos para desenvolvedores. Mas os aplicativos que eles criam afetarão a todos. Por exemplo, um desenvolvedor pode criar um aplicativo tradutor em tempo actual, permitindo que os usuários conversem com pessoas em diferentes idiomas.

Muitas empresas já estão testando esses novos modelos. A Zillow está construindo um assistente de voz que pode pesquisar casas e agendar passeios a partir de uma única solicitação falada. Priceline pode verificar seus voos e hotéis, cancelá-los e reservar novos. O Vimeo está usando-o para transcrição em tempo actual e assim por diante.

O preço começa em US$ 0,017 por minuto para Whisper, US$ 0,034 por minuto para Translate e US$ 32 por 1 milhão de tokens de entrada de áudio para GPT-Realtime-2.