As equipes empresariais que ajustam seus modelos de incorporação RAG para obter melhor precisão podem estar degradando involuntariamente a qualidade de recuperação da qual esses pipelines dependem, de acordo com uma nova pesquisa da Redis.

O artigo, “Treinamento para sensibilidade composicional reduz a generalização de recuperação densa”, testou o que acontece quando as equipes treinam modelos de incorporação para sensibilidade composicional. Essa é a capacidade de captar frases que parecem quase idênticas, mas significam algo diferente – “o cachorro mordeu o homem” versus “o homem mordeu o cachorro”, ou uma negação que inverte totalmente o significado de uma afirmação. Esse treinamento quebrou consistentemente a generalização de recuperação densa, o quão bem um modelo recupera corretamente em tópicos e domínios amplos nos quais não foi treinado especificamente. O desempenho caiu de 8 a 9 por cento em modelos menores e de 40 por cento em um modelo de incorporação de tamanho médio atual que as equipes estão usando ativamente na produção. As descobertas têm implicações diretas para as equipes empresariais que constroem pipelines de IA de agentes, onde a qualidade da recuperação determina qual contexto flui para a cadeia de raciocínio de um agente. Um erro de recuperação em um pipeline de estágio único retorna uma resposta errada. O mesmo erro em um pipeline de agente pode desencadear uma cascata de ações erradas no downstream.

Srijith Rajamohan, líder de pesquisa de IA da Redis e um dos autores do artigo, disse que a descoberta desafia uma suposição generalizada sobre como a recuperação baseada em incorporação realmente funciona.

“Existe uma noção geral de que quando você usa pesquisa semântica ou similaridade semântica semelhante, obtemos a intenção correta. Isso não é necessariamente verdade”, disse Rajamohan ao VentureBeat. “Uma semelhança semântica próxima ou alta não significa realmente uma intenção exata.”

A geometria por trás da compensação de recuperação

Os modelos de incorporação funcionam comprimindo uma frase inteira em um único ponto em um espaço de alta dimensão e, em seguida, encontrando os pontos mais próximos de uma consulta no momento da recuperação. Isso funciona bem para correspondência ampla de tópicos – documentos sobre assuntos semelhantes acabam próximos uns dos outros. O problema é que duas frases com palavras quase idênticas, mas com significados opostos, também acabam próximas uma da outra, porque o modelo funciona a partir do conteúdo da palavra e não da estrutura.

Foi isso que a pesquisa quantificou. Quando as equipes ajustam um modelo de incorporação para separar sentenças estruturalmente diferentes – ensinando-o que uma inversão de negação que inverte o significado de uma afirmação não é igual ao authentic – o modelo usa o espaço representacional que estava usando anteriormente para uma ampla recordação de tópicos. Os dois objetivos competem pelo mesmo vetor. A pesquisa também descobriu que a regressão não é uniforme entre os tipos de falha. Os erros de negação e de inversão espacial melhoraram de forma mensurável com o treinamento estruturado. Erros vinculativos – onde um modelo confunde qual modificador se aplica a qual palavra, como a qual parte recai uma obrigação contratual – quase não foram alterados. Para as equipes empresariais, isso significa que o problema de precisão é mais difícil de resolver exatamente nos casos em que errar tem maiores consequências.

A razão pela qual a maioria das equipes não percebe isso é que as métricas de ajuste fino medem a tarefa para a qual estão sendo treinadas, e não o que acontece com a recuperação geral em tópicos não relacionados. Um modelo pode mostrar uma forte melhoria na rejeição de quase acidente durante o treinamento, ao mesmo tempo em que regride silenciosamente no trabalho de recuperação mais amplo para o qual foi contratado. A regressão só surge na produção.

Rajamohan disse que o instinto que a maioria das equipes busca – mudar para um modelo de incorporação maior – não aborda a arquitetura subjacente. “Você não pode escapar disso”, disse ele. “Não é um problema que você possa resolver com mais dimensões e mais parâmetros.”

Por que todas as alternativas padrão ficam aquém

O instinto pure quando a precisão da recuperação falha é recorrer a abordagens adicionais. A pesquisa testou vários deles e descobriu que cada um falha de uma maneira diferente.

Pesquisa híbrida. Combinar a recuperação baseada em incorporação com a pesquisa por palavras-chave já é uma prática padrão para preencher lacunas de precisão. Mas Rajamohan disse que a pesquisa por palavra-chave não consegue detectar o modo de falha que esta pesquisa identifica, porque o problema não é falta de palavras – é uma estrutura mal interpretada. “Se você tiver uma frase como ‘Roma está mais perto que Paris’ e outra que diz ‘Paris está mais perto que Roma’, e você fizer uma recuperação de incorporação seguida de uma pesquisa de texto, você não conseguirá dizer a diferença”, disse ele. “As mesmas palavras existem em ambas as frases.”

Reclassificação do MaxSim. Algumas equipes adicionam uma segunda camada de pontuação que compara palavras de consulta individuais com palavras de documentos individuais, em vez de depender de um único vetor compactado. Essa abordagem, conhecida como MaxSim ou interação tardia e usada em sistemas como o ColBERT, melhorou as pontuações de benchmark de relevância na pesquisa. Mas falhou completamente na rejeição de quase-acidentes estruturais, atribuindo-lhes pontuações de similaridade de quase identidade.

O problema é que relevância e identidade são objetivos diferentes. MaxSim é otimizado para o primeiro e cego para o último. Uma equipe que adiciona MaxSim e vê melhorias no benchmark pode estar resolvendo um problema diferente daquele que tem.

Codificadores cruzados. Eles funcionam alimentando a consulta e o documento candidato no modelo simultaneamente, permitindo que ele examine cada palavra com cada palavra antes de tomar uma decisão. Essa comparação completa é o que os torna precisos – e o que os torna caros demais para serem executados em escala de produção. Rajamohan disse que sua equipe os investigou. Eles trabalham no laboratório e quebram volumes reais de consultas.

Memória contextual. Às vezes também chamados de memória agente, esses sistemas são cada vez mais citados como o caminho além do RAG, mas Rajamohan disse que mudar para esse tipo de arquitetura não elimina o problema de recuperação estrutural. Esses sistemas ainda dependem da recuperação no momento da consulta, o que significa que os mesmos modos de falha se aplicam. A principal diferença são os requisitos de latência mais flexíveis, não uma correção de precisão.

A correção em dois estágios que a pesquisa validou

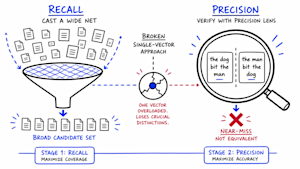

O traço comum em todas as abordagens com falha é o mesmo: um único mecanismo de pontuação tentando lidar com o recall e a precisão ao mesmo tempo. A pesquisa validou uma arquitetura diferente: pare de tentar fazer os dois trabalhos com um vetor e atribua cada trabalho a um estágio dedicado.

Estágio um: recall. O primeiro estágio funciona exatamente como a recuperação densa padrão funciona hoje – o modelo de incorporação compacta documentos em vetores e recupera as correspondências mais próximas de uma consulta. Nada muda aqui. O objetivo é lançar uma rede ampla e trazer de volta rapidamente um conjunto de candidatos fortes. Velocidade e amplitude são o que importa neste estágio, não a precisão perfeita.

Estágio dois: precisão. O segundo estágio é onde reside a correção. Em vez de pontuar candidatos com um único número de similaridade, um pequeno modelo de Transformer aprendido examina a consulta e cada candidato no nível do token – comparando palavras individuais com palavras individuais para detectar incompatibilidades estruturais, como inversões de negação ou inversões de papéis. Esta é a etapa de verificação que a abordagem de vetor único não pode realizar.

Os resultados. No treinamento completo, o verificador Transformer superou todas as outras abordagens testadas pela pesquisa sobre rejeição estrutural de quase acidente. Foi a única abordagem que detectou de forma confiável os modos de falha que o sistema de vetor único não percebeu.

A compensação. Adicionar um estágio de verificação custa latência. O custo da latência depende da quantidade de verificação que uma equipe executa. Para cargas de trabalho sensíveis à precisão, como aplicações jurídicas ou contábeis, é garantida a verificação completa em cada consulta. Para pesquisas de uso geral, uma verificação mais leve pode ser suficiente.

A pesquisa surgiu de um problema actual de produção. Os clientes corporativos que executavam sistemas de cache semântico estavam recebendo respostas rápidas, mas semanticamente incorretas – o sistema de recuperação tratava consultas com sons semelhantes como idênticas, mesmo quando seu significado period diferente. A arquitetura de dois estágios é a solução proposta pela Redis, com incorporação em seu produto LangCache no roteiro, mas ainda não disponível para os clientes.

O que isso significa para equipes empresariais

A pesquisa não exige que as equipes empresariais reconstruam seus pipelines de recuperação do zero. Mas exige que eles testem suposições que a maioria das equipes nunca examinou – sobre o que seus modelos de incorporação estão realmente fazendo, em quais métricas vale a pena confiar e onde residem as verdadeiras lacunas de precisão na produção.

Reconheça a compensação antes de contorná-la. Rajamohan disse que o primeiro passo prático é compreender que a regressão existe. Ele avalia qualquer sistema de recuperação baseado em LLM com base em três critérios: correção, integridade e utilidade. As falhas de correção se espalham diretamente para as outras duas, o que significa que um sistema de recuperação que obtém bons resultados em benchmarks de relevância, mas falha em quase-acidentes estruturais, está produzindo uma falsa sensação de prontidão de produção.

O RAG não está obsoleto – mas saiba o que ele não pode fazer. Rajamohan rejeitou firmemente as alegações de que o RAG foi substituído. “Isso é uma simplificação enorme”, disse ele. “RAG é um pipeline muito simples que pode ser produzido por quase qualquer pessoa com muito pouca sustentação.” A pesquisa não argumenta contra o RAG como arquitetura. Ele argumenta contra a suposição de que um pipeline RAG de estágio único com um modelo de incorporação ajustado esteja pronto para produção para cargas de trabalho sensíveis à precisão.

A correção é actual, mas não gratuita. Para equipes que precisam de maior precisão, Rajamohan disse que a arquitetura de dois estágios não é um aumento de implementação proibitivo, mas adicionar um estágio de verificação custa latência. “É um problema de mitigação”, disse ele. “Não é algo que possamos realmente resolver.”