A period da IA generativa começou para a maioria das pessoas com o lançamento do ChatGPT da OpenAI no final de 2022mas a tecnologia subjacente – a arquitetura de rede neural “Transformer” que permite que os modelos de IA avaliem a importância de diferentes palavras em uma frase (ou pixels em uma imagem) de maneira diferente e treinem informações em paralelo – remonta ao artigo seminal do Google de 2017 “Atenção é tudo que você precisa.”

No entanto, embora os Transformers ofereçam uma qualidade de modelo incomparável e tenham sustentado a maioria dos principais modelos generativos de IA usados atualmente, eles são computacionalmente glutões. Eles são sobrecarregados por demandas de computação quadrática e memória linear que tornam a inferência em grande escala um empreendimento caro e muitas vezes proibitivo. Daí o desejo de alguns pesquisadores de melhorá-los desenvolvendo uma nova arquitetura, Mamba, em 2023, que passou a ser incluída em modelos híbridos Mamba-Transformer como o Nemotron 3 Tremendous da Nvidia.

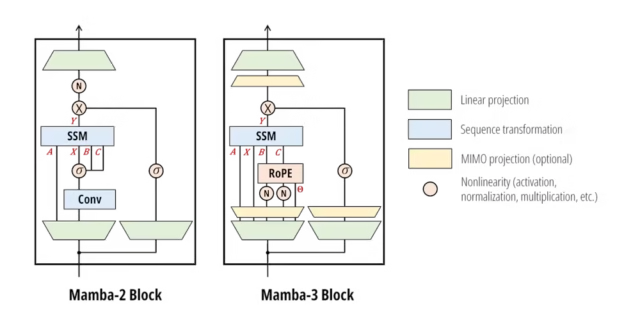

Agora, os mesmos pesquisadores por trás da arquitetura authentic do Mamba, incluindo os líderes Albert Gu, da Carnegie Mellon, e Tri Dao, de Princeton, lançou a versão mais recente de sua nova arquitetura, Mamba-3como um modelo de linguagem sob uma licença permissiva de código aberto Apache 2.0 — tornando-o imediatamente disponível para desenvolvedores, incluindo empresas para fins comerciais. Um artigo técnico também foi publicado em arXiv.org.

Este modelo sinaliza uma mudança de paradigma da eficiência do treinamento para um design que prioriza a inferência. Como Gu observou no anúncio oficial, enquanto o Mamba-2 se concentrava em quebrar gargalos de pré-treinamento, o Mamba-3 visa resolver o problema da “GPU fria”: a realidade de que durante a decodificação, o {hardware} moderno muitas vezes permanece ocioso, aguardando o movimento da memória em vez de realizar a computação.

Perplexidade (não, não a empresa) e a nova eficiência do Mamba 3

Mamba, incluindo Mamba 3, é um tipo de Modelo de Espaço de Estados (SSM).

Estas são efetivamente uma “máquina de resumo” de alta velocidade para IA. Embora muitos modelos populares (como os por trás do ChatGPT) tenham que reexaminar cada palavra que já viram para entender o que vem a seguir – o que fica mais lento e mais caro quanto mais a conversa dura – um SSM mantém um estado interno compacto e em constante mudança. Este estado é essencialmente um “instantâneo psychological” digital de todo o histórico dos dados.

À medida que novas informações fluem, o modelo simplesmente atualiza esse instantâneo em vez de reler tudo desde o início. Isto permite que a IA processe grandes quantidades de informação, como bibliotecas inteiras de livros ou longos filamentos de ADN, com uma velocidade incrível e requisitos de memória muito mais baixos.

Para apreciar o salto que o Mamba-3 representa, é preciso primeiro compreender a perplexidade, a principal métrica utilizada na investigação para medir a qualidade do modelo.

No contexto da modelagem de linguagem, a perplexidade é uma medida de quão “surpreso” um modelo fica com novos dados.

Pense em um modelo como um jogador profissional. Se um modelo apresenta alta perplexidade, ele não sabe ao certo onde fazer suas apostas; ele vê muitas próximas palavras possíveis como igualmente prováveis.

Uma pontuação de perplexidade mais baixa indica que o modelo é mais “certo” – tem uma melhor compreensão dos padrões subjacentes da linguagem humana. Para os construtores de IA, a perplexidade serve como um proxy de alta fidelidade para a inteligência.

O avanço relatado na investigação do Mamba-3 é que este atinge uma perplexidade comparável à do seu antecessor, o Mamba-2, ao mesmo tempo que utiliza apenas metade do tamanho do estado. Isso significa que um modelo pode ser igualmente inteligente e ao mesmo tempo ter operação duas vezes mais eficiente.

Uma nova filosofia

A filosofia que orienta o Mamba-3 é uma mudança basic na forma como pensamos sobre a “inteligência” da IA versus a velocidade do {hardware} em que ele é executado. Enquanto a geração anterior, Mamba-2, foi projetada para ser treinada em velocidades recordes, Mamba-3 é uma arquitetura de “inferência em primeiro lugar” – inferência que se refere à forma como os modelos de IA são servidos aos usuários finais, por meio de websites como ChatGPT ou Google Gemini, ou por meio de interfaces de programação de aplicativos (APIs).

O objetivo principal do Mamba 3 é maximizar cada segundo que o chip do computador (GPU) está ativo, garantindo que o modelo pense o máximo possível sem fazer o usuário esperar por uma resposta.

No mundo dos modelos de linguagem, cada ponto de precisão é conquistado com dificuldade. Na escala de 1,5 bilhão de parâmetros, a variante “MIMO” mais avançada do Mamba-3 alcançou uma precisão média de 57,6% em todos os benchmarks, representando um salto de 2,2 pontos percentuais em relação ao Transformer padrão da indústria.

Embora um salto de dois pontos possa parecer modesto, na verdade representa um aumento relativo de quase 4% na capacidade de modelagem de linguagem em comparação com a linha de base do Transformer. Ainda mais impressionante, como mencionado acima, o Mamba-3 pode igualar a qualidade preditiva do seu antecessor enquanto usa apenas metade do “tamanho do estado” interno, entregando efetivamente o mesmo nível de inteligência com significativamente menos atraso de memória.

Durante anos, as alternativas eficientes aos Transformers sofreram com uma “lacuna lógica” – muitas vezes falharam em tarefas simples de raciocínio, como acompanhar padrões ou resolver aritmética básica, porque a sua matemática interna period demasiado rígida. O Mamba-3 resolve isso introduzindo estados de valores complexos.

Esta atualização matemática atua como uma bússola interna, permitindo que o modelo represente a lógica “rotacional”. Ao usar esta abordagem “rotativa”, o Mamba-3 pode resolver quase perfeitamente quebra-cabeças lógicos e tarefas de rastreamento de estado que seus antecessores só podiam adivinhar, finalmente equiparando o poder de raciocínio dos modelos lineares aos sistemas mais avançados.

A peça last do quebra-cabeça é como o Mamba-3 interage com o {hardware} físico. A maioria dos modelos de IA atuais são “ligados à memória”, o que significa que o chip do computador passa a maior parte do tempo ocioso, aguardando que os dados passem da memória para o processador.

O Mamba-3 introduz uma formulação Multi-Enter, Multi-Output (MIMO) que muda fundamentalmente esta dinâmica. Ao realizar até quatro vezes mais operações matemáticas em paralelo durante cada etapa, o Mamba-3 utiliza esse poder anteriormente “ocioso”. Isso permite que o modelo “pense” significativamente mais para cada palavra que gera, sem aumentar o tempo actual que um usuário gasta esperando por uma resposta. Mais sobre isso abaixo.

Três novos saltos tecnológicos

O apelo dos modelos lineares sempre foram seus requisitos constantes de memória e escala de computação linear.

Porém, como apontam os autores do Mamba 3, “não existe almoço grátis”. Ao fixar o tamanho do estado para garantir a eficiência, esses modelos são forçados a comprimir todo o contexto histórico em uma única representação – exatamente o oposto do crescente cache KV de um Transformer. O Mamba-3 usa três alavancas específicas para fazer com que esse estado fixo funcione mais.

1. Discretização Exponencial-Trapezoidal

Os Modelos de Espaço de Estados são fundamentalmente sistemas de tempo contínuo que devem ser “discretizados” para lidar com sequências discretas de dados digitais.

As iterações anteriores dependiam da discretização “Exponential-Euler” – uma heurística que fornecia apenas uma aproximação de primeira ordem do sistema.

Mamba-3 apresenta um regra trapezoidal generalizadafornecendo aproximação precisa de segunda ordem. Isto não é apenas um refinamento matemático; induz uma “convolução implícita” dentro da recorrência central.

Ao combinar isso com termos de viés B e C explícitos, os pesquisadores conseguiram remover a curta convolução causal que tem sido um elemento básico das arquiteturas recorrentes há anos.

2. SSMs de valor complexo e o “truque RoPE”

Uma das críticas mais persistentes aos modelos lineares tem sido a sua incapacidade de resolver tarefas simples de rastreamento de estado, como determinar a paridade de uma sequência de bits.

Esta falha decorre da restrição da matriz de transição a números reais, o que impede o modelo de representar dinâmicas “rotacionais”. O Mamba-3 supera isso vendo o SSM subjacente como de valor complexo.

Usando o que a equipe chama de “Truque de corda,” eles demonstram que uma atualização de estado de valor complexo é matematicamente equivalente a uma incorporação rotativa dependente de dados (RoPE) aplicada às projeções de entrada e saída.

Isto permite ao Mamba-3 resolver tarefas de raciocínio sintético que eram impossíveis para o Mamba-2.

3. MIMO: Aumentando a intensidade aritmética

O salto mais significativo na eficiência da inferência vem da transição de Entrada Única, Saída Única (SISO) para Múltiplas entradas, múltiplas saídas (MIMO) SSM.

Em um SSM padrão, a atualização de estado é uma operação de produto externo fortemente vinculada à memória. Ao mudar para uma atualização de estado baseada em multiplicação de matrizes, o Mamba-3 aumenta a “intensidade aritmética” do modelo – a proporção de FLOPs em relação ao tráfego de memória.

Isso permite que o modelo execute mais cálculos durante a fase de decodificação vinculada à memória. Essencialmente, o Mamba-3 utiliza os núcleos de computação “inativos” da GPU para aumentar a potência do modelo “de graça”, mantendo a mesma velocidade de decodificação de seus antecessores mais simples.

O que o Mamba 3 significa para empresas e construtores de IA

Para as empresas, o Mamba-3 representa uma mudança estratégica no custo complete de propriedade (TCO) para implantações de IA.

-

Custo x desempenho: Pelo desempenho de parâmetros correspondentes, o Mamba-3 (MIMO) corresponde à perplexidade do Mamba-2 enquanto usa metade do tamanho do estado. Para implantação empresarial, isso efetivamente duplica o rendimento de inferência para o mesmo espaço de {hardware}.

-

Fluxos de Trabalho Agentes: à medida que as organizações avançam em direção a fluxos de trabalho de agentes paralelos (como codificação automatizada ou agentes de atendimento ao cliente em tempo actual), a demanda por geração de baixa latência aumenta exponencialmente. O Mamba-3 foi projetado especificamente para evitar que o {hardware} da GPU fique “frio” durante essas tarefas.

-

A vantagem híbrida: Os pesquisadores prevêem que o futuro da IA empresarial reside em modelos híbridos. Ao intercalar o Mamba-3 com a autoatenção, as organizações podem combinar a “memória” eficiente dos SSMs com o armazenamento preciso do “banco de dados” dos Transformers.

Disponibilidade, licenciamento e uso

Mamba-3 não é apenas um artigo de pesquisa teórica; é uma versão de código aberto totalmente realizada, disponível para uso imediato com código de modelo publicado em GitHub.

O projeto é lançado sob a licença Apache-2.0. Esta é uma licença permissiva e favorável aos negócios que permite uso gratuito, modificação e distribuição comercial sem exigir a divulgação de código-fonte proprietário.

Esta versão é boa para desenvolvedores que criam aplicativos de longo contexto, agentes de raciocínio em tempo actual ou aqueles que buscam reduzir custos de GPU em ambientes de produção de alto quantity.

Liderando a revolução dos Modelos Espaciais de Estado (SSM)

O lançamento foi recebido com entusiasmo nas redes sociais, principalmente no que diz respeito à natureza “liderada pelos alunos” do projeto. Gu, cuja biografia do X / Twitter descreve-o como “liderando a revolução SSM”, deu todo o crédito aos líderes estudantis, incluindo Aakash Lahoti e Kevin Y. Li

Tópico de .Gu destacou a satisfação da equipe com o design:

“Estamos muito felizes com o design last do modelo! As três principais mudanças metodológicas são inspiradas (imo) em alguns métodos e matemática elegantes.”

À medida que os fluxos de trabalho de agentes impulsionam a demanda de inferência “às alturas”, a chegada do Mamba-3 sugere que o futuro da IA pode não ser apenas ter o maior modelo, mas também ter o mais eficiente.

O Mamba-3 realinhou com sucesso o SSM com as realidades do {hardware} moderno, provando que mesmo na period do Transformer, os princípios da teoria clássica de controle ainda têm um papel important a desempenhar.