A fabricante chinesa de eletrônicos e automóveis Xiaomi surpreendeu hoje a comunidade international de IA com o lançamento do MiMo-V2-Proum novo modelo básico de 1 trilhão de parâmetros com benchmarks que se aproximam dos gigantes de IA dos EUA, OpenAI e Anthropic, mas com cerca de um sétimo ou sexto do custo quando acessado por meio de API proprietária – e, mais importante, enviando menos de 256.000 tokens de informações de um lado para outro.

Liderado por Fuli Luo, um veterano do projeto disruptivo DeepSeek R1, o lançamento representa o que Luo caracteriza como uma “emboscada silenciosa” na fronteira international. Além disso, Luo afirmou em um X postagem que a empresa planeja abrir o código-fonte de uma variante do modelo deste último lançamento, “quando os modelos estiverem estáveis o suficiente para merecê-lo”.

Ao concentrar-se no “espaço de acção” da inteligência – passando da geração de código para a operação autónoma de “garras” digitais – a Xiaomi está a tentar ultrapassar completamente o paradigma conversacional.

Antes desta incursão na IA de fronteira, a Xiaomi, com sede em Pequim, estabeleceu-se como um titã da “Web das Coisas” e do {hardware} de consumo.

Globalmente reconhecida como o terceiro maior fabricante mundial de smartphones, a Xiaomi passou o início da década de 2020 a executar uma entrada de alto risco no setor automóvel. Os seus veículos eléctricos (EV), como o SU7 e o recentemente lançado SUV YU7, transformaram a empresa numa potência verticalmente integrada, capaz de fundir {hardware}, software program e, agora, raciocínio avançado.

Este pedigree em engenharia do mundo físico informa a arquitetura do MiMo-V2-Professional; foi construído para ser o “cérebro” de sistemas complexos, quer esses sistemas estejam a gerir cadeias de abastecimento globais ou a navegar nos intrincados andaimes de um agente de codificação autónomo.

Tecnologia: A arquitetura da agência

O desafio central da “Period dos Agentes” é manter um raciocínio de alta fidelidade em grandes extensões de dados, sem incorrer num “imposto de inteligência” proibitivo em termos de latência ou custo. O MiMo-V2-Professional aborda isso por meio de uma arquitetura esparsa: embora abrigue parâmetros totais de 1T, apenas 42B estão ativos durante qualquer passagem de avanço único, tornando-o aproximadamente três vezes o tamanho de seu antecessor, MiMo-V2-Flash.

A eficiência do modelo está enraizada em um mecanismo evoluído de Atenção Híbrida. Os transformadores padrão normalmente enfrentam um aumento quadrático nos requisitos de computação à medida que o contexto cresce; MiMo-V2-Professional utiliza uma proporção híbrida de 7:1 (aumentada de 5:1 na versão Flash) para gerenciar sua enorme janela de contexto de 1 milhão de tokens. Esta escolha arquitetônica permite que o modelo mantenha uma “memória” profunda de tarefas de longa execução sem a degradação de desempenho normalmente vista em modelos de fronteira.

A analogia: pense no modelo não como um estudante lendo um livro página por página, mas como um pesquisador especialista em uma vasta biblioteca. A proporção de 7:1 permite que o modelo “percorra” 85% dos dados em busca de contexto, ao mesmo tempo que aplica atenção de alta densidade aos 15% mais relevantes para a tarefa em questão.

Isso é combinado com uma camada leve de Multi-Token Prediction (MTP), que permite ao modelo antecipar e gerar vários tokens simultaneamente, reduzindo drasticamente a latência necessária para as fases de “pensamento” dos fluxos de trabalho de agente. De acordo com Luo, estas decisões estruturais foram tomadas com meses de antecedência, especificamente para proporcionar uma “vantagem estrutural” face à velocidade inesperada com que a indústria passou a ter agentes.

Produto e benchmarking: uma verificação da realidade de terceiros

Os dados internos da Xiaomi mostram um modelo que se destaca em tarefas do “mundo actual” em relação aos benchmarks sintéticos. No GDPval-AA, um benchmark que mede o desempenho em tarefas de trabalho do mundo actual, o MiMo-V2-Professional alcançou um Elo de 1426, colocando-o à frente dos principais pares chineses como GLM-5 (1406) e Kimi K2.5 (1283).

Embora ainda fique atrás dos modelos ocidentais de “esforço máximo”, como Claude Sonnet 4.6 (1633) em Elo bruto, representa o desempenho mais alto registrado para um modelo de origem chinesa nesta categoria.

A organização de benchmarking terceirizada A Análise Artificial verificou essas afirmaçõescolocando o MiMo-V2-Professional em 10º lugar em seu Índice de Inteligência international com uma pontuação de 49. Isso o coloca no mesmo nível do Codex GPT-5.2 e à frente do Grok 4.20 Beta. Estes resultados sugerem que a Xiaomi construiu com sucesso um modelo capaz de raciocínio de alto nível necessário para tarefas de engenharia e produção.

As principais métricas da Análise Synthetic destacam um salto significativo em relação à versão anterior de pesos abertos, MiMo-V2-Flash (que obteve 41 pontos):

-

Taxa de alucinação: O modelo Professional reduziu as taxas de alucinação para 30%, uma melhoria acentuada em relação aos 48% do modelo Flash.

-

Índice de onisciência: Ele marcou +5, colocando-o à frente do GLM-5 (+2) e do Kimi K2.5 (-8).

-

Eficiência do token: Para executar todo o Índice de Inteligência, o MiMo-V2-Professional exigiu apenas 77 milhões de tokens de saída, significativamente menos que o GLM-5 (109 milhões) ou o Kimi K2.5 (89 milhões), indicando um processo de raciocínio mais conciso e eficiente.

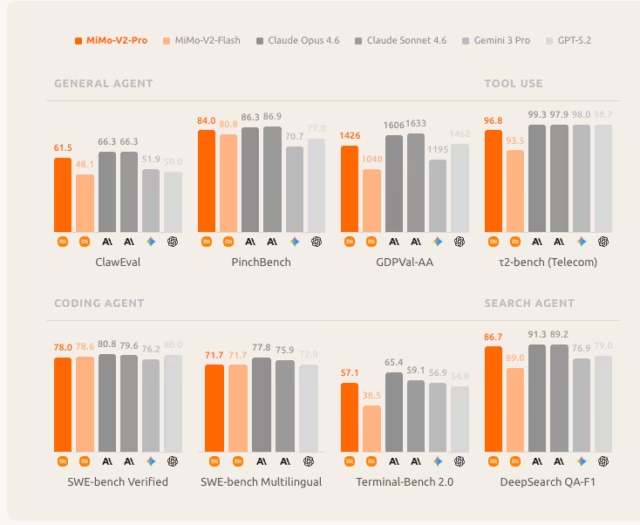

Os próprios gráficos da Xiaomi enfatizam ainda mais suas capacidades de “Agente Geral” e “Agente de Codificação”. No ClawEval, uma referência para andaimes de agentes, o modelo obteve pontuação de 61,5, aproximando-se do desempenho de Claude Opus 4,6 (66,3) e superando significativamente o GPT-5,2 (50,0). Em ambientes específicos de codificação como Terminal-Bench 2.0, alcançou 86,7, sugerindo alta confiabilidade ao executar comandos em um ambiente de terminal ativo.

Como as empresas devem avaliar o uso do MiMo-V2-Professional

Para as personas delineadas nas organizações contemporâneas de IA – da infraestrutura à segurança – o MiMo-V2-Professional representa uma mudança de paradigma na curva “Preço-Qualidade”.

Os tomadores de decisão de infraestrutura considerarão o MiMo-V2-Professional um candidato atraente para a fronteira Pareto de inteligência versus custo. A Synthetic Evaluation relatou que a execução de seu índice custou apenas US$ 348 para o MiMo-V2-Professional, em comparação com US$ 2.304 para o GPT-5.2 e US$ 2.486 para o Claude Opus 4.6.

Para organizações que gerenciam clusters de GPU ou compras, a capacidade de acessar as 10 principais informações globais por aproximadamente 1/7 do custo dos operadores históricos ocidentais é um incentivo poderoso para testes em escala de produção.

Os tomadores de decisão de dados podem aproveitar a janela de contexto de 1 milhão para arquiteturas prontas para RAG, permitindo-lhes alimentar bases de código empresariais inteiras ou conjuntos de documentação em um único immediate, sem a fragmentação exigida por modelos de contexto menores.

Um tomador de decisão de sistemas/orquestração deve avaliar o MiMo-V2-Professional como um “cérebro” primário para coordenação multiagente. Como o modelo é otimizado para OpenClaw e Claude Code, ele pode lidar com o planejamento de longo prazo e o uso preciso de ferramentas sem a constante intervenção humana que assola os modelos anteriores.

Sua alta classificação no GDPval-AA sugere que ele é particularmente adequado para o fluxo de trabalho e a camada de orquestração necessária para dimensionar a IA em toda a empresa. Ele permite a criação de sistemas que podem ir além da simples automação para a solução de problemas complexos e em várias etapas.

Contudo, os decisores de segurança devem ter cautela. A própria natureza “agentica” que torna o modelo poderoso – sua capacidade de usar terminais e manipular arquivos – aumenta a área de superfície para injeção imediata e acesso não autorizado ao modelo.

Embora sua baixa taxa de alucinação (30%) seja um benefício defensivo, a falta de pesos públicos (ao contrário da versão Flash) significa que as equipes de segurança interna não podem realizar auditorias profundas em “nível de modelo” às vezes necessárias para implantações altamente confidenciais. Qualquer implementação empresarial deve ser acompanhada por protocolos robustos de monitorização e auditabilidade.

Preço, disponibilidade e o caminho a seguir

A Xiaomi fixou o preço do MiMo-V2-Professional para dominar o mercado de desenvolvedores. O preço é escalonado com base no uso do contexto, com taxas competitivas de armazenamento em cache para dar suporte a tarefas de raciocínio de alta frequência.

-

MiMo-V2-Professional (até 256K): US$ 1 por 1 milhão de tokens de entrada e US$ 3 por 1 milhão de tokens de saída

-

MiMo-V2-Professional (256K-1M): US$ 2 por 1 milhão de tokens de entrada e US$ 6 por 1 milhão de tokens de saída

-

Leitura de cache: US$ 0,20 por 1 milhão de tokens para o nível inferior e US$ 0,40 para o nível superior

-

Escrita em cache: Temporariamente gratuito ($0)

Veja como ele se compara a outros modelos de fronteira líderes em todo o mundo:

Esse posicionamento agressivo foi projetado para incentivar os fluxos de aplicativos de alta intensidade que definem a próxima geração de software program. O modelo está atualmente disponível apenas através da API authentic da Xiaomi, sem suporte atual para imagem ou entrada multimodal – uma omissão notável em uma period de modelos “Omni”, embora a Xiaomi tenha apresentado um MiMo-V2-Omni separado para essas necessidades.

O período “Hunter Alpha” no OpenRouter provou que o mercado tem um grande apetite por esta combinação específica de eficiência e raciocínio. A filosofia de Fuli Luo – de que a velocidade da investigação é alimentada por um “amor genuíno pelo mundo para o qual se está a construir” – resultou num modelo que ocupa o 2º lugar na China e o 8º a nível mundial nos índices de inteligência estabelecidos.

Se permanecerá uma emboscada “silenciosa” ou se tornará a base para um realinhamento international do poder da IA, depende da rapidez com que os desenvolvedores adotam o “espaço de ação” em vez da “janela de bate-papo”. Por enquanto, a Xiaomi mudou as traves: a questão não é mais apenas “será que ele pode falar?” mas “ele pode agir?”