Os grandes modelos de linguagem estão a atingir limites em domínios que exigem uma compreensão do mundo físico – desde a robótica à condução autónoma e à produção. Essa restrição está empurrando os investidores para modelos mundiais, com a AMI Labs levantando uma rodada inicial de US$ 1,03 bilhão emblem após World Labs garantiu US$ 1 bilhão.

Os grandes modelos de linguagem (LLMs) são excelentes no processamento de conhecimento abstrato por meio da previsão do próximo token, mas carecem fundamentalmente de base na causalidade física. Eles não podem prever com segurança as consequências físicas das ações no mundo actual.

Os pesquisadores e líderes de pensamento em IA falam cada vez mais sobre essas limitações à medida que a indústria tenta empurrar a IA para fora dos navegadores da internet e para dentro dos espaços físicos. Em entrevista ao podcaster Dwarkesh PatelRichard Sutton, ganhador do Prêmio Turing, alertou que os LLMs apenas imitam o que as pessoas dizem em vez de modelar o mundo, o que limita sua capacidade de aprender com a experiência e de se ajustar às mudanças no mundo.

É por isso que os modelos baseados em LLMs, incluindo modelos de linguagem de visão (VLMs), podem apresentar um comportamento frágil e quebrar com mudanças muito pequenas nas suas entradas.

CEO do Google DeepMind Demis Hassabis ecoou esse sentimento em outra entrevista, apontando que os modelos atuais de IA sofrem de “inteligência irregular”. Eles podem resolver olimpíadas complexas de matemática, mas falham em física básica porque faltam capacidades críticas em relação à dinâmica do mundo actual.

Para resolver este problema, os investigadores estão a mudar o foco para a construção de modelos mundiais que funcionam como simuladores internos, permitindo que os sistemas de IA testem hipóteses com segurança antes de tomarem medidas físicas. No entanto, “modelos mundiais” é um termo genérico que abrange várias abordagens arquitetónicas distintas.

Isso produziu três abordagens arquitetônicas distintas, cada uma com diferentes compensações.

JEPA: construído para tempo actual

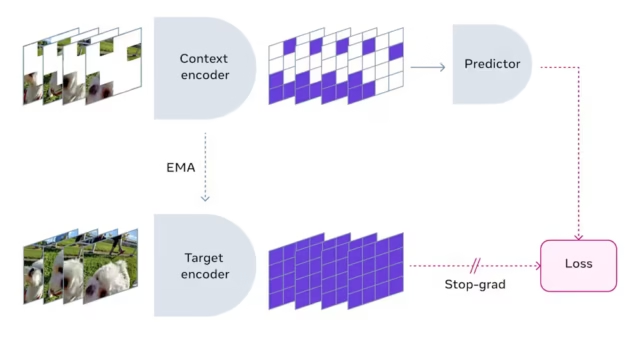

A primeira abordagem principal concentra-se no aprendizado de representações latentes em vez de tentar prever a dinâmica do mundo no nível do pixel. Aprovado pela AMI Labs, este método é fortemente baseado na Joint Embedding Predictive Structure (JEPA).

Os modelos JEPA tentam imitar a forma como os humanos entendem o mundo. Quando observamos o mundo, não memorizamos cada pixel ou detalhe irrelevante de uma cena. Por exemplo, se você observar um carro passando por uma rua, você monitora sua trajetória e velocidade; você não calcula o reflexo exato da luz em cada folha das árvores ao fundo.

Os modelos JEPA reproduzem este atalho cognitivo humano. Em vez de forçar a rede neural a prever exatamente como será o próximo quadro de um vídeo, o modelo aprende um conjunto menor de recursos abstratos ou “latentes”. Ele descarta os detalhes irrelevantes e concentra-se inteiramente nas regras básicas de como os elementos da cena interagem. Isso torna o modelo robusto contra ruídos de fundo e pequenas alterações que quebram outros modelos.

Essa arquitetura é altamente eficiente em termos de computação e memória. Ao ignorar detalhes irrelevantes, são necessários muito menos exemplos de treinamento e executados com latência significativamente menor. Essas características o tornam adequado para aplicações onde a eficiência e a inferência em tempo actual não são negociáveis, como robótica, carros autônomos e fluxos de trabalho empresariais de alto risco.

Por exemplo, a AMI está em parceria com a empresa de saúde Nabla para utilizar esta arquitetura para simular a complexidade operacional e reduzir a carga cognitiva em ambientes de saúde de ritmo acelerado.

Yann LeCun, pioneiro da arquitetura JEPA e cofundador da AMI, explicou que modelos mundiais baseados em JEPA são projetados para serem “controláveis no sentido de que você pode dar-lhes objetivos e, por construção, a única coisa que eles podem fazer é atingir esses objetivos” em entrevista à Newsweek.

Splats gaussianos: construídos para o espaço

Uma segunda abordagem baseia-se em modelos generativos para construir ambientes espaciais completos a partir do zero. Adotado por empresas como Laboratórios Mundiaiseste método recebe um immediate inicial (pode ser uma imagem ou uma descrição textual) e usa um modelo generativo para criar um splat gaussiano 3D. Um splat gaussiano é uma técnica para representar cenas 3D usando milhões de minúsculas partículas matemáticas que definem a geometria e a iluminação. Ao contrário da geração de vídeo plano, essas representações 3D podem ser importadas diretamente para motores físicos e 3D padrão, como o Unreal Engine, onde os usuários e outros agentes de IA podem navegar livremente e interagir com eles de qualquer ângulo.

O principal benefício aqui é uma redução drástica no tempo e no custo único de geração necessários para criar ambientes 3D interativos complexos. Ele aborda exatamente o problema descrito pelo fundador do World Labs, Fei-Fei Li, que observou que os LLMs são, em última análise, como “letristas no escuro”, possuindo uma linguagem floreada, mas sem inteligência espacial e experiência física. O modelo Marble do World Labs dá à IA aquela consciência espacial que falta.

Embora essa abordagem não seja projetada para execução em frações de segundo e em tempo actual, ela tem um enorme potencial para computação espacial, entretenimento interativo, design industrial e construção de ambientes de treinamento estático para robótica. O valor empresarial é evidente na solução da Autodesk forte apoio do World Labs para integrar esses modelos em suas aplicações de design industrial.

Geração ponta a ponta: construída para escala

A terceira abordagem usa um modelo generativo de ponta a ponta para processar prompts e ações do usuário, gerando continuamente a cena, a dinâmica física e as reações em tempo actual. Em vez de exportar um arquivo 3D estático para um mecanismo físico externo, o próprio modelo atua como mecanismo. Ele ingere um immediate inicial junto com um fluxo contínuo de ações do usuário e gera os quadros subsequentes do ambiente em tempo actual, calculando a física, a iluminação e as reações dos objetos nativamente.

DeepMind Gênio 3 e da Nvidia Cosmos enquadram-se nesta categoria. Esses modelos fornecem uma interface altamente simples para gerar experiências interativas infinitas e grandes volumes de dados sintéticos. DeepMind demonstrou isso nativamente com Genie 3mostrando como o modelo mantém a permanência estrita dos objetos e a física consistente a 24 quadros por segundo sem depender de um módulo de memória separado.

Essa abordagem se traduz diretamente em fábricas de dados sintéticos de alto desempenho. A Nvidia Cosmos usa essa arquitetura para dimensionar dados sintéticos e raciocínio físico de IA, permitindo que desenvolvedores de veículos autônomos e robótica sintetizem condições raras e perigosas de casos extremos sem o custo ou risco de testes físicos. Waymo (uma subsidiária da Alphabet) construiu seu modelo mundial em cima do Genie 3, adaptando-o para treinar seus carros autônomos.

A desvantagem desse método generativo de ponta a ponta é o grande custo de computação necessário para renderizar continuamente a física e os pixels simultaneamente. Ainda assim, o investimento é necessário para alcançar a visão apresentada por Hassabis, que argumenta que é necessária uma compreensão profunda e interna da causalidade física porque a IA atual carece de capacidades críticas para operar com segurança no mundo actual.

O que vem a seguir: arquiteturas híbridas

Os LLM continuarão a servir como interface de raciocínio e comunicação, mas os modelos mundiais estão a posicionar-se como infra-estruturas fundamentais para pipelines de dados físicos e espaciais. À medida que os modelos subjacentes amadurecem, vemos o surgimento de arquiteturas híbridas que aproveitam os pontos fortes de cada abordagem.

Por exemplo, a startup de segurança cibernética DeepTempo desenvolveu recentemente LogLMum modelo que integra elementos de LLMs e JEPA para detectar anomalias e ameaças cibernéticas de registros de segurança e de rede.