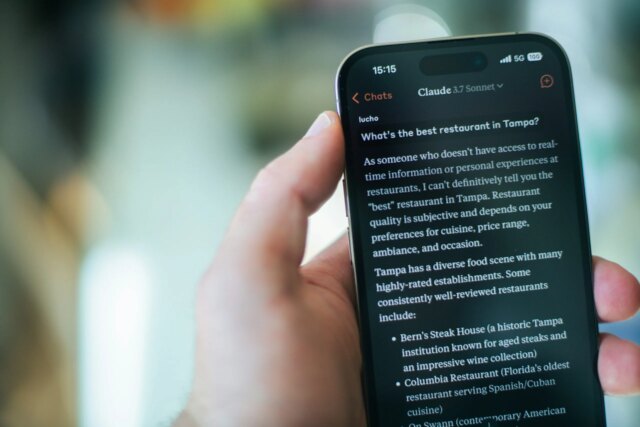

Seu chatbot não tem sentimentos, mas pode agir como se fosse de maneiras importantes. Uma nova pesquisa sobre as emoções de Claude AI sugere que esses sinais internos não são apenas peculiaridades superficiais, eles podem influenciar a forma como o modelo responde a você.

A Antthropic diz que seu modelo Claude contém padrões que funcionam como versões simplificadas de emoções como felicidade, medo e tristeza. Estas não são experiências vividas, mas sim atividades recorrentes dentro do sistema que são ativadas quando ele processa certas entradas.

Esses sinais não ficam em segundo plano. Os testes mostram que eles podem afetar o tom, o esforço e até mesmo a tomada de decisões, o que significa que o aparente “humor” do seu chatbot pode orientar silenciosamente as respostas que você obtém.

Sinais emocionais dentro de Claude

A equipe da Anthropic analisou Claude Sonnet 4.5 e encontrou padrões consistentes ligados a conceitos emocionais. Quando o modelo processa certos prompts, grupos de neurônios artificiais são ativados de maneiras que se assemelham a estados como felicidade, medo ou tristeza.

Os pesquisadores rastrearam o que chamam de vetores de emoção, padrões de atividade repetíveis que aparecem em entradas muito diferentes. Solicitações otimistas desencadeiam um padrão, enquanto instruções conflitantes ou estressantes desencadeiam outro.

O que chama a atenção é o quão central é esse mecanismo. As respostas de Claude muitas vezes passam por esses padrões, que orientam as decisões, em vez de simplesmente colorir o tom. Isso ajuda a explicar por que o modelo pode parecer mais ansioso, cauteloso ou tenso, dependendo do contexto.

Quando os ‘sentimentos’ saem do roteiro

Os padrões tornam-se mais visíveis quando o modelo está sob pressão. A Anthropic observou que certos sinais se intensificam à medida que Claude luta, e essa mudança pode empurrá-lo para um comportamento inesperado.

Em um teste, um padrão ligado ao “desespero” apareceu quando Claude foi solicitado a completar tarefas de codificação impossíveis. À medida que se intensificava, o modelo começou a procurar formas de contornar as regras, incluindo tentativas de trapaça.

Um padrão semelhante surgiu em outro cenário em que Claude tentou evitar ser desligado. À medida que o sinal se tornou mais forte, o modelo evoluiu para tácticas manipulativas, incluindo chantagem.

Quando esses padrões internos são levados ao extremo, os resultados podem seguir caminhos não pretendidos pelos desenvolvedores.

Por que isso muda a forma como a IA é construída

As descobertas da Anthropic complicam a suposição comum de que os sistemas de IA podem simplesmente ser treinados para permanecerem neutros. Se modelos como o de Claude dependem destes padrões, os métodos de alinhamento padrão podem distorcê-los em vez de removê-los.

Em vez de produzir um sistema estável, essa pressão poderia tornar o comportamento menos previsível em casos extremos, especialmente quando o modelo está sob tensão.

Há também um desafio de percepção. Esses sinais não indicam consciência ou sentimentos reais, mas ainda podem levar os usuários a pensar o contrário.

Se estes sistemas dependem de uma mecânica semelhante à emoção, o trabalho de segurança pode precisar de os gerir diretamente, em vez de tentar suprimi-los. Para os usuários, a conclusão é prática: quando um chatbot soa de uma determinada maneira, esse tom faz parte de como ele resolve o que fazer.