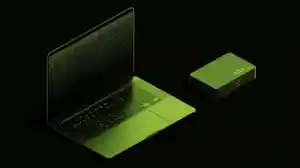

Nvidia na segunda-feira revelou um supercomputador de mesa poderoso o suficiente para executar modelos de IA com até um trilhão de parâmetros – aproximadamente a escala do GPT-4 – sem tocar na nuvem. A máquina, chamada Estação DGXcontém 748 gigabytes de memória coerente e 20 petaflops de computação em uma caixa ao lado de um monitor, e pode ser o produto de computação pessoal mais significativo desde que o Mac Professional authentic convenceu os profissionais criativos a abandonar as estações de trabalho.

O anúncio, feito na reunião anual da empresa Conferência GTC em San José, chega num momento em que a indústria da IA se debate com uma tensão basic: os modelos mais poderosos do mundo requerem uma enorme infra-estrutura de centros de dados, mas os programadores e as empresas que desenvolvem esses modelos querem cada vez mais manter os seus dados, os seus agentes e a sua propriedade intelectual locais. A Estação DGX é a resposta da Nvidia – uma máquina de seis dígitos que reduz a distância entre a fronteira da IA e a mesa de um único engenheiro.

O que realmente significam 20 petaflops na sua área de trabalho

O Estação DGX é construído em torno do novo Superchip de desktop GB300 Grace Blackwell Ultraque funde uma CPU Grace de 72 núcleos e uma GPU Blackwell Extremely por meio da interconexão NVLink-C2C da Nvidia. Esse hyperlink fornece 1,8 terabytes por segundo de largura de banda coerente entre os dois processadores – sete vezes a velocidade do PCIe Gen 6 – o que significa que a CPU e a GPU compartilham um pool único e contínuo de memória, sem os gargalos que normalmente prejudicam o trabalho de IA de desktop.

Vinte petaflops – 20 quatrilhões de operações por segundo – teriam classificado esta máquina entre os melhores supercomputadores do mundo há menos de uma década. O sistema Summit em Laboratório Nacional de Oak Ridgeque ocupou o primeiro lugar mundial em 2018, teve cerca de dez vezes esse desempenho, mas ocupou uma sala do tamanho de duas quadras de basquete. A Nvidia está agregando uma fração significativa dessa capacidade em algo que pode ser conectado a uma tomada de parede.

Os 748 GB de memória unificada são sem dúvida o número mais importante. Modelos de trilhões de parâmetros são redes neurais enormes que devem ser totalmente carregadas na memória para serem executadas. Sem memória suficiente, a velocidade de processamento não importa – o modelo simplesmente não cabe. A estação DGX supera essa barreira, e faz isso com uma arquitetura coerente que elimina as penalidades de latência do transporte de dados entre os swimming pools de memória da CPU e da GPU.

Agentes sempre ativos precisam de {hardware} sempre ativo

A Nvidia projetou o Estação DGX explicitamente para o que vê como a próxima fase da IA: agentes autônomos que raciocinam, planejam, escrevem códigos e executam tarefas continuamente – não apenas sistemas que respondem a prompts. Cada grande anúncio em GTC 2026 reforçou esta tese de “IA agente”, e a Estação DGX é onde esses agentes devem ser construídos e executados.

O emparelhamento de chaves é Nemo Garrauma nova pilha de código aberto que a Nvidia também anunciou na segunda-feira. NemoClaw reúne modelos abertos Nemotron da Nvidia com OpenShellum tempo de execução seguro que impõe proteções de segurança, rede e privacidade baseadas em políticas para agentes autônomos. Um único comando instala toda a pilha. Jensen Huang, fundador e CEO da Nvidia, enquadrou a combinação em termos inconfundíveis, chamando OpenClaw – a plataforma de agente mais ampla suportada pelo NemoClaw – “o sistema operacional para IA pessoal” e comparando-o diretamente com Mac e Home windows.

O argumento é direto: as instâncias de nuvem aumentam e diminuem sob demanda, mas os agentes sempre ativos precisam de computação persistente, memória persistente e estado persistente. Uma máquina sob sua mesa, funcionando 24 horas por dia, 7 dias por semana, com dados locais e modelos locais dentro de uma área restrita de segurança, é arquitetonicamente mais adequada para essa carga de trabalho do que uma GPU alugada no knowledge middle de outra pessoa. A Estação DGX pode operar como um supercomputador pessoal para um desenvolvedor solo ou como um nó de computação compartilhado para equipes, e suporta configurações isoladas para ambientes classificados ou regulamentados onde os dados nunca podem sair do edifício.

Do protótipo de mesa à produção do knowledge middle sem reescritas

Um dos aspectos mais inteligentes do design da Estação DGX é o que a Nvidia chama de continuidade arquitetônica. Os aplicativos criados na máquina migram perfeitamente para os sistemas de knowledge middle GB300 NVL72 da empresa – racks de 72 GPU projetados para fábricas de IA em hiperescala – sem rearquitetar uma única linha de código. A Nvidia está vendendo um pipeline integrado verticalmente: protótipo em sua mesa e escalado para a nuvem quando estiver pronto.

Isso é importante porque o maior custo oculto no desenvolvimento de IA hoje não é a computação – é o tempo de engenharia perdido para reescrever código para diferentes configurações de {hardware}. Um modelo ajustado em um cluster de GPU native geralmente requer retrabalho substancial para implantação em infraestrutura de nuvem com diferentes arquiteturas de memória, pilhas de rede e dependências de software program. A estação DGX elimina esse atrito ao executar a mesma pilha de software program NVIDIA AI que alimenta todos os níveis da infraestrutura da Nvidia, desde o Faísca DGX para Vera Rubin NVL72.

A Nvidia também expandiu o DGX Spark, irmão menor do Station, com novo suporte de cluster. Até quatro unidades Spark agora podem operar como um sistema unificado com escala de desempenho quase linear – um “knowledge middle de desktop” que cabe em uma mesa de conferência sem infraestrutura de rack ou tíquete de TI. Para equipes que precisam ajustar modelos de médio porte ou desenvolver agentes de menor escala, os Sparks agrupados oferecem uma plataforma de IA departamental confiável por uma fração do custo da Estação.

Os primeiros compradores revelam para onde o mercado está indo

A lista inicial de clientes da DGX Station mapeia os setores onde a IA está fazendo a transição mais rápida de experimento para ferramenta operacional diária. Snowflake está usando o sistema para testar localmente sua estrutura de treinamento de código aberto no Ártico. EPRIo Electrical Energy Analysis Institute, está avançando na previsão meteorológica baseada em IA para fortalecer a confiabilidade da rede elétrica. A Medivis está integrando modelos de linguagem de visão em fluxos de trabalho cirúrgicos. A Microsoft Analysis e a Cornell implantaram os sistemas para treinamento prático de IA em grande escala.

Os sistemas estão disponíveis para encomenda agora e serão enviados nos próximos meses a partir de Asus, Tecnologias Dell, GIGABYTE, MSIe Supermicrocom HP ingressando no remaining do ano. A Nvidia não divulgou os preços, mas os componentes GB300 e os preços históricos da empresa DGX sugerem um investimento de seis dígitos – caro para os padrões das estações de trabalho, mas notavelmente barato em comparação com os custos da GPU em nuvem para executar inferência de trilhões de parâmetros em escala.

A lista de modelos suportados ressalta o quão aberto o ecossistema de IA se tornou: os desenvolvedores podem executar e ajustar OpenAIs gpt-oss-120bGoogle Gema 3, Qwen3, Mistral Grande 3, DeepSeek V3.2e os próprios modelos Nemotron da Nvidia, entre outros. A Estação DGX é independente de modelo por design – um {hardware} suíço em um setor onde as fidelidades aos modelos mudam trimestralmente.

A verdadeira estratégia da Nvidia: possuir todas as camadas da pilha de IA, da órbita ao escritório

O Estação DGX não chegou no vácuo. Period uma peça de um conjunto abrangente de GTC 2026 anúncios que mapeiam coletivamente a ambição da Nvidia de fornecer computação de IA literalmente em todas as escalas físicas.

No topo, a Nvidia revelou o Plataforma Vera Rubin – sete novos chips em plena produção – ancorados pelo rack Vera Rubin NVL72, que integra 72 GPUs Rubin de próxima geração e afirma uma taxa de transferência de inferência até 10x maior por watt em comparação com a geração atual da Blackwell. O CPU Veracom 88 núcleos Olympus personalizados, tem como alvo a camada de orquestração que as cargas de trabalho de agente exigem cada vez mais. Na fronteira distante, a Nvidia anunciou o Módulo Espacial Vera Rubin para knowledge facilities orbitais, fornecendo 25x mais computação de IA para inferência baseada no espaço do que o H100.

Entre a órbita e o escritório, a Nvidia revelou parcerias que abrangem a Adobe para IA criativa, montadoras como BYD e Nissan para veículos autônomos de nível 4, uma coalizão com Mistral AI e sete outros laboratórios para construir modelos de fronteira aberta, e Dynamo 1.0, um sistema operacional de inferência de código aberto já adotado pela AWS, Azure, Google Cloud e uma lista de empresas nativas de IA, incluindo Cursor e Perplexity.

O padrão é inconfundível: a Nvidia quer ser a plataforma de computação – {hardware}, software program e modelos – para cada carga de trabalho de IA, em qualquer lugar. O Estação DGX é a peça que preenche a lacuna entre a nuvem e o indivíduo.

A nuvem não está morta, mas o seu monopólio sobre o trabalho sério de IA está acabando

Nos últimos anos, a suposição padrão em IA tem sido que o trabalho sério requer instâncias de GPU em nuvem – alugar {hardware} Nvidia de AWS, Azulou Google Nuvem. Esse modelo funciona, mas acarreta custos reais: taxas de saída de dados, latência, exposição à segurança resultante do envio de dados proprietários para infra-estruturas de terceiros e a perda basic de controlo inerente ao aluguer do computador de outra pessoa.

O Estação DGX não mata a nuvem – o negócio de knowledge middle da Nvidia supera sua receita de desktops e está acelerando. Mas cria uma alternativa native credível para uma categoria importante e crescente de cargas de trabalho. Treinar um modelo de fronteira do zero ainda exige milhares de GPUs em um warehouse. Ajustando um modelo aberto de trilhões de parâmetros em dados proprietários? Executando inferência para um agente interno que processa documentos confidenciais? Prototipando antes de se comprometer com gastos na nuvem? Uma máquina embaixo da sua mesa começa a parecer uma escolha racional.

Esta é a elegância estratégica do produto: expande o mercado endereçável da Nvidia para a infra-estrutura pessoal de IA, ao mesmo tempo que reforça o negócio da nuvem, porque tudo o que é construído localmente é concebido para se adaptar às plataformas de knowledge middle da Nvidia. Não é nuvem versus mesa. É nuvem e mesa, e a Nvidia fornece ambos.

Um supercomputador em cada mesa – e um agente que nunca dorme em cima dele

O slogan definidor da revolução do PC period “um computador em cada mesa e em cada casa”. Quatro décadas depois, a Nvidia está atualizando a premissa com uma escalada desconfortável. O Estação DGX coloca o poder genuíno de supercomputação – do tipo usado em laboratórios nacionais – ao lado de um teclado, e o NemoClaw coloca um agente de IA autônomo em cima dele que funciona 24 horas por dia, escrevendo códigos, chamando ferramentas e completando tarefas enquanto seu proprietário dorme.

Se esse futuro é estimulante ou perturbador depende do seu ponto de vista. Mas uma coisa não é mais discutível: a infraestrutura necessária para construir, executar e possuir a IA de ponta acabou de passar da sala de servidores para a gaveta da mesa. E a empresa que vende quase todos os chips de IA sérios do planeta apenas certificou-se de vender também a gaveta da mesa.