Cada pipeline LangChain que sua equipe codifica começa a quebrar no momento em que a distribuição da consulta muda – e sempre muda. Esse gargalo é o que a Sakana AI se propôs a eliminar.

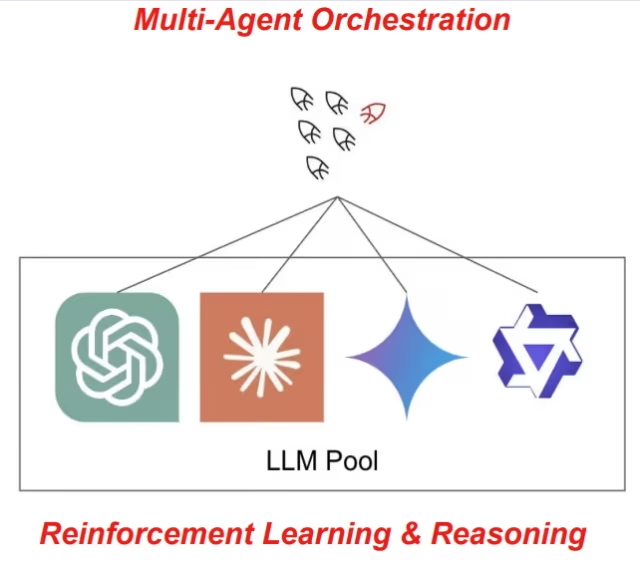

Pesquisadores da Sakana AI introduziram o “Condutor RL“um pequeno modelo de linguagem treinado por meio de aprendizagem por reforço para orquestrar automaticamente um conjunto diversificado de LLMs de trabalhadores. O Conductor analisa dinamicamente as entradas, distribui o trabalho entre os trabalhadores e coordena entre os agentes.

Essa coordenação automatizada alcança resultados de última geração em benchmarks difíceis de raciocínio e codificação, superando modelos de fronteira individuais como GPT-5 e Claude Sonnet 4, bem como pipelines multiagentes caros projetados por humanos. Ela alcança esse desempenho por uma fração do custo e com menos chamadas de API que os concorrentes. RL Conductor é a espinha dorsal do Fugu, o serviço comercial de orquestração multiagente da Sakana AI.

As limitações das estruturas de agência manuais

Grandes modelos de linguagem possuem fortes capacidades latentes. Mas aproveitar ao máximo essas capacidades é um grande desafio. A extração desse nível de desempenho depende muito de fluxos de trabalho de agentes projetados manualmente, que servem como componentes críticos em produtos comerciais de IA.

No entanto, essas estruturas são insuficientes porque são inerentemente rígidas e restritas. Em comentários ao VentureBeat, Yujin Tang, coautor do artigo, explicou o ponto exato de ruptura dos sistemas atuais: “Embora o uso de estruturas com pipelines codificados como LangChain e Combination-of-Brokers possa funcionar bem para casos de uso específicos… Na produção, surge um gargalo inerente ao direcionar domínios com grandes bases de usuários com demandas muito heterogêneas.”

Tang observou que alcançar “a generalização do mundo actual em aplicações tão heterogêneas exige inerentemente ir além dos designs codificados por humanos”.

Outro gargalo na construção de sistemas de agentes robustos é que nenhum modelo único é perfect para todas as tarefas. Diferentes modelos são ajustados para se especializarem em domínios distintos. Um modelo pode ser excelente em raciocínio científico, enquanto outro é superior em geração de código, lógica matemática ou planejamento de alto nível.

Como os modelos têm essas características variadas e habilidades complementares, é praticamente impossível prever e codificar manualmente a combinação perfect de modelos para cada consulta. Uma estrutura de agência perfect deve ser capaz de analisar um problema e delegar subtarefas ao especialista mais adequado do grupo.

Conduzindo uma orquestra de agentes

O RL Conductor foi projetado para superar as limitações de estruturas rígidas projetadas por humanos. Como o nome indica, ele conduz uma orquestra de agentes dividindo problemas desafiadores, delegando subtarefas específicas e projetando topologias de comunicação para um conjunto de LLMs de trabalho.

Em vez de depender de código fixo ou roteamento estático, o Conductor orquestra esses modelos gerando um fluxo de trabalho personalizado. Para cada etapa do fluxo de trabalho, o modelo gera uma instrução em linguagem pure para um aspecto específico da tarefa, atribui um agente para realizá-la e outline uma “lista de acesso” que determina quais subtarefas anteriores e respostas de outros agentes serão incluídas no contexto daquele agente.

Ao definir tudo em linguagem pure, o Conductor cria fluxos de trabalho flexíveis e adaptados a cada entrada. Ele pode construir cadeias sequenciais simples, estruturas de árvores paralelas ou até mesmo loops recursivos dependendo das demandas do problema.

É importante ressaltar que o modelo aprende essas estratégias não por projeto humano, mas por meio de aprendizagem por reforço (RL) e maximização de recompensas. Durante o treinamento, o modelo recebe uma tarefa, um grupo de trabalhadores e um sinal de recompensa com base na correção da resposta e do formato de saída.

Por meio de um algoritmo RL simples de tentativa e erro, o modelo descobre organicamente quais combinações de instruções e estruturas de comunicação geram a maior recompensa. Como resultado, ele adota automaticamente estratégias avançadas de orquestração, como engenharia de immediate direcionada, refinamento iterativo e otimização de meta-prompt.

O modelo aprende a ajustar dinamicamente suas estratégias e aproveitar os pontos fortes distintos de seus agentes de trabalho sem que nenhum desenvolvedor humano exact codificar o processo.

Maestro em ação

Para testar o RL Conductor em ação, os pesquisadores ajustaram o parâmetro de 7 bilhões Qwen2.5-7B usando a estrutura. Durante o treinamento, o Condutor foi encarregado de projetar fluxos de trabalho de ação de até cinco etapas. Foi-lhe dado acesso a um pool de trabalhadores contendo sete modelos diferentes: três gigantes de código fechado (Gemini 2.5 Professional, Claude-Sonnet-4 e GPT-5) e quatro modelos de código aberto (incluindo DeepSeek-R1-Distill-Qwen-32B, Gemma3-27B e Qwen3-32B).

A equipe avaliou o Conductor em uma variedade de benchmarks altamente desafiadores, comparando-o com modelos de fronteira individuais agindo sozinhos, agentes de autorreflexão solicitados iterativamente a melhorar suas próprias respostas e estruturas de roteamento multiagentes de última geração, como MASRouter, Combination-of-Brokers (MoA), RouterDC e Smoothie. O pequeno 7B Conductor estabeleceu novos padrões de referência em todos os níveis. Alcançou uma pontuação média de 77,27% em todas as tarefas, atingindo 93,3% no benchmark matemático AIME25, 87,5% no GPQA-Diamond e 83,93% no LiveCodeBench, de acordo com os pesquisadores.

Notavelmente, ele alcançou essas marcas mantendo-se altamente eficiente. Embora modelos básicos como o MoA queimassem 11.203 tokens por pergunta, o Conductor usou uma média de apenas 1.820 tokens, realizando uma média de apenas três etapas por fluxo de trabalho.

Uma análise mais detalhada dos detalhes experimentais mostra exatamente por que a estrutura é tão eficaz. O Maestro aprendeu automaticamente a medir a dificuldade da tarefa. Para questões simples de recordação factual, muitas vezes resolvia o problema em uma única etapa ou usava uma configuração básica de dois agentes. No entanto, para problemas complexos de codificação, ela criou fluxos de trabalho extensos envolvendo até quatro agentes com fases dedicadas de planejamento, implementação e verificação.

O Maestro também aprendeu que os modelos de fronteira têm diferentes pontos fortes. Para obter pontuações recordes em benchmarks de codificação, o Conductor frequentemente designava Gemini 2.5 Professional e Claude Sonnet 4 para atuarem como planejadores de alto nível, e só trazia o GPT-5 no ultimate para escrever o código ultimate otimizado. Numa demonstração particularmente inteligente de adaptabilidade, o Maestro às vezes abdicava completamente do seu próprio papel, entregando todo o processo de planeamento ao Gemini 2.5 Professional e permitindo-lhe ditar as subtarefas para o resto do grupo.

Além dos benchmarks de matemática e codificação, a Sakana AI já está colocando a arquitetura subjacente para funcionar em utilitários de front-office. “Temos usado internamente nossos modelos Fugu baseados na tecnologia Conductor para diversas aplicações empresariais práticas: desenvolvimento de software program, pesquisa profunda, desenvolvimento de estratégia e até mesmo tarefas visuais como geração de slides”, disse Tang.

Trazendo orquestração para a empresa: Sakana Fugu

Embora o modelo 7B descrito no artigo de pesquisa fosse um projeto exploratório e não estivesse disponível publicamente, a Sakana AI transformou a estrutura do Conductor em seu principal produto comercial de IA, Sakana Fugu. Agora em fase beta, o Fugu atua como um sistema de orquestração multiagente acessível por meio de uma API padrão compatível com OpenAI.

Tang observou que Fugu tem como alvo “o grande mercado de indústrias onde a adoção da IA ainda não trouxe grandes ganhos de produtividade devido às limitações de generalização dos atuais pipelines codificados, como finanças e defesa”.

Para desenvolvedores corporativos, isso permite uma integração perfeita em aplicativos existentes, sem a dor de cabeça de gerenciar várias chaves de API ou rotear tarefas manualmente entre diferentes fornecedores. Por trás da interface API, o Fugu automatiza topologias de colaboração complexas e atribuições de funções em um conjunto de modelos. Para atender às diversas necessidades de negócios, a Sakana lançou duas variantes: Fugu Mini, desenvolvido para operações de baixa latência, e Fugu Extremely, projetado para desempenho máximo em cargas de trabalho exigentes.

Abordando as preocupações de governança em torno de agentes autônomos que geram fluxos de trabalho invisíveis, Tang apontou que os riscos de interpretabilidade são funcionalmente semelhantes aos traços de raciocínio ocultos das atuais APIs fechadas de nível superior, e o sistema é gerenciado com proteções estabelecidas para minimizar alucinações.

Para arquitetos corporativos que estão avaliando quando implantar a orquestração RL em vez do roteamento tradicional, a decisão geralmente se resume a recursos de engenharia. “Acreditamos que o ponto perfect ocorre sempre que os usuários e suas equipes sentem que estão gastando uma quantidade desproporcional de tempo orientando seus agentes subjacentes”, disse Tang. No entanto, ele alertou que a estrutura não é necessária para tudo, observando que “é difícil superar a proposta econômica de um modelo native rodando diretamente na máquina do usuário para consultas simples”.

À medida que a diversidade de modelos especializados de IA de código aberto e fechado continua a crescer, os pipelines estáticos codificados inevitavelmente se tornarão obsoletos. Olhando para o futuro, esta orquestração dinâmica provavelmente se estenderá além dos ambientes de texto e código. “Há de fato um grande potencial para preencher essa lacuna com estruturas de Condutores intermodais tornando-se a base para sistemas físicos de IA mais autônomos e autocoordenados”, disse Tang.