Um dos principais desafios da construção de agentes de IA eficazes é ensiná-los a escolher entre usar ferramentas externas ou confiar no seu conhecimento interno. Mas grandes modelos de linguagem são frequentemente treinados para invocar ferramentas cegamente, o que causa gargalos de latência, custos desnecessários de API e raciocínio degradado causado por ruído ambiental.

Para superar esse desafio, os pesquisadores do Alibaba introduziram Otimização de política hierárquica dissociada (HDPO), uma estrutura de aprendizagem por reforço que treina agentes para equilibrar eficiência de execução e precisão de tarefas.

Metis, um modelo multimodal que eles treinaram usando esta estrutura, reduz invocações redundantes de ferramentas de 98% para apenas 2%, ao mesmo tempo que estabelece uma nova precisão de raciocínio de última geração nos principais benchmarks do setor. Esta estrutura ajuda a criar agentes de IA que não são acionados e sabem quando se abster de usar ferramentas, permitindo o desenvolvimento de sistemas de agentes responsivos e econômicos.

O déficit metacognitivo

Os atuais modelos de agente enfrentam o que os pesquisadores chamam de “profundo déficit metacognitivo”. Os modelos têm dificuldade em decidir quando usar seu conhecimento paramétrico interno e quando consultar um utilitário externo. Como resultado, eles invocam cegamente ferramentas e APIs, como pesquisa na internet ou execução de código, mesmo quando o immediate do usuário já contém todas as informações necessárias para resolver a tarefa.

Esse comportamento de chamada de ferramenta cria sérios obstáculos operacionais para aplicações do mundo actual. Como os modelos são treinados para focar quase inteiramente na conclusão da tarefa, eles são indiferentes à latência. Esses agentes frequentemente atingem taxas exorbitantes de chamadas de ferramentas. Cada chamada externa desnecessária à API introduz um gargalo no processamento serial, transformando uma IA tecnicamente capaz em um sistema lento que frustra os usuários e esgota os orçamentos das ferramentas.

Ao mesmo tempo, queimar recursos computacionais com o uso excessivo de ferramentas não se traduz em melhor raciocínio. Interações redundantes de ferramentas injetam ruído no contexto do modelo. Esse ruído pode distrair o modelo, inviabilizando uma cadeia de raciocínio que de outra forma seria sólida e degradando ativamente o resultado last.

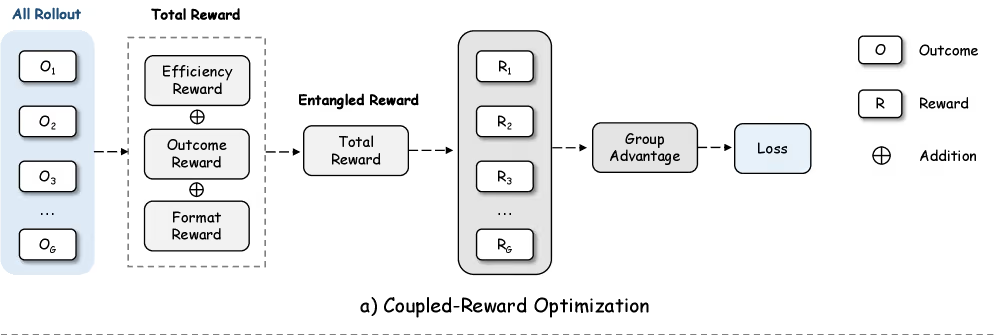

Para resolver os problemas de latência e custo da invocação cega de ferramentas, os métodos anteriores de aprendizagem por reforço tentaram penalizar o uso excessivo de ferramentas, combinando a precisão da tarefa e a eficiência de execução em um sinal de recompensa. No entanto, esse design emaranhado cria um dilema de otimização insolúvel. Se a penalidade de eficiência for muito agressiva, o modelo se tornará excessivamente conservador e suprimirá o uso de ferramentas essenciais, sacrificando a correção em tarefas árduas. Por outro lado, se a penalidade for leve, o sinal de otimização perde seu valor e não evita o uso excessivo da ferramenta em tarefas mais simples.

Além disso, esta recompensa compartilhada cria ambiguidade semântica, onde uma trajetória imprecisa com zero chamadas de ferramentas pode render a mesma recompensa que uma trajetória precisa com uso excessivo de ferramentas. Como os sinais de treinamento para precisão e eficiência ficam emaranhados, o modelo não consegue aprender a controlar o uso de ferramentas sem degradar suas principais capacidades de raciocínio.

Otimização de política hierárquica dissociada

Para resolver o dilema de otimização das recompensas acopladas, os pesquisadores introduziram o HDPO. HDPO separa precisão e eficiência em dois canais de otimização independentes. O canal de precisão concentra-se em maximizar a correção das tarefas em todas as implementações do modelo. O canal de eficiência otimiza a economia de execução.

O HDPO calcula os sinais de treinamento para esses dois canais de forma independente e os combina apenas no estágio last do cálculo das perdas. O sinal de eficiência está condicionado ao canal de precisão. Isso significa que uma resposta incorreta nunca é recompensada simplesmente por ser rápida ou usar menos ferramentas. Essa dissociação evita situações em que os gradientes de precisão e eficiência se anulam, fornecendo à IA sinais de aprendizagem claros para ambos os objetivos.

A propriedade emergente mais poderosa deste design dissociado é que ele cria um currículo cognitivo implícito. No início do treinamento, quando o modelo ainda tem dificuldades com a tarefa, a otimização é dominada pelo objetivo de precisão, forçando o modelo a priorizar o aprendizado do raciocínio e do conhecimento corretos. À medida que as capacidades de raciocínio do modelo amadurecem e ele chega consistentemente às respostas certas, o sinal de eficiência aumenta suavemente. Esse mecanismo faz com que o modelo primeiro domine a resolução de tarefas e só então refine sua autossuficiência, evitando chamadas de API redundantes e dispendiosas.

Para complementar o HDPO, os pesquisadores desenvolveram um regime rigoroso de curadoria de dados em vários estágios que aborda falhas graves encontradas em conjuntos de dados existentes aumentados por ferramentas. Seu pipeline de curadoria de dados cobre os estágios de ajuste fino supervisionado (SFT) e aprendizado por reforço (RL).

Para a fase SFT, eles obtiveram dados de trajetórias multimodais aumentadas por ferramentas disponíveis publicamente e os filtraram para remover exemplos de baixa qualidade contendo falhas de execução ou inconsistências de suggestions. Eles também filtraram agressivamente qualquer amostra de treinamento que o modelo básico pudesse resolver diretamente, sem ferramentas. Por fim, usando o Gemini 3.1 Professional do Google como juiz automatizado, eles filtraram o corpus SFT para manter apenas exemplos que demonstrassem o uso de ferramentas estratégicas.

Para a fase RL, a curadoria se concentrou em garantir um sinal de otimização estável. Eles filtraram prompts com recursos visuais corrompidos ou ambigüidade semântica. O algoritmo HDPO depende da comparação de respostas corretas e incorretas. Se uma tarefa é trivialmente fácil, onde o modelo sempre acerta, ou proibitivamente difícil, onde o modelo sempre falha, não há variação matemática significativa com a qual aprender. A equipe manteve estritamente apenas os prompts que exibiam uma mistura não trivial de sucessos e fracassos para garantir um sinal de gradiente acionável.

Agente Metis: HDPO em ação

Para testar o HDPO em ação, os pesquisadores usaram a estrutura para desenvolver o Metis, um agente de raciocínio multimodal equipado com ferramentas de codificação e pesquisa. Metis é construído sobre o modelo de linguagem de visão Qwen3-VL-8B-Instruct. Os pesquisadores treinaram-no em duas etapas distintas. Primeiro, eles aplicaram SFT usando seus dados selecionados para fornecer uma inicialização a frio. Em seguida, eles aplicaram RL usando a estrutura HDPO, expondo o modelo a interações multivoltas onde poderia invocar ferramentas como execução de código Python, pesquisa de texto e pesquisa de imagens.

Os pesquisadores compararam o Metis com modelos de visão de código aberto padrão, como LLaVA-OneVision, raciocinadores somente de texto e modelos de agente de última geração, incluindo DeepEyes V2 e Skywork-R1V4 de 30 bilhões de parâmetros. A avaliação abrangeu duas áreas principais: percepção visible e conjuntos de dados de compreensão de documentos, como HRBench e V*Bench, e tarefas rigorosas de raciocínio matemático e lógico, como WeMath e MathVista.

Em todas as tarefas, a Metis alcançou desempenho de última geração ou altamente competitivo, superando os modelos de agência existentes – incluindo o muito maior Skywork-R1V4 de 30 bilhões de parâmetros – tanto em tarefas de percepção visible quanto de raciocínio.

Igualmente importante é o comportamento anedótico que Metis mostrou nos experimentos. Por exemplo, quando apresentados à imagem de uma placa de museu e questionados sobre o que diz o texto central, os modelos de agente padrão perdem tempo escrevendo cegamente scripts Python para recortar a imagem apenas para lê-la. Metis, no entanto, reconhece que o texto é claramente legível na imagem bruta. Ele ignora totalmente as ferramentas e usa uma única passagem de inferência.

Em outro experimento, o modelo recebeu um gráfico complexo e foi solicitado a identificar a segunda linha mais alta em um ponto de dados específico dentro de uma pequena subparcela. A Metis reconheceu que a análise visible refinada excedia suas capacidades de resolução nativa e não conseguia distinguir com precisão as linhas sobrepostas. Em vez de adivinhar a partir da imagem completa, ele invocou o Python para cortar e ampliar exclusivamente aquela região específica da subtrama, permitindo identificar corretamente a linha. Ele trata o código como um instrumento de precisão implantado apenas quando a evidência visible é genuinamente ambígua, e não como um substituto padrão.

Os pesquisadores divulgaram Métis junto com o código para HDPO sob a licença permissiva Apache 2.0.

“Nossos resultados demonstram que o uso de ferramentas estratégicas e um forte desempenho de raciocínio não são uma compensação; em vez disso, a eliminação de chamadas de ferramentas ruidosas e redundantes contribui diretamente para uma precisão superior”, concluem os pesquisadores. “De forma mais ampla, nosso trabalho sugere uma mudança de paradigma na aprendizagem aumentada por ferramentas: de meramente ensinar modelos como executar ferramentas, para cultivar a sabedoria metacognitiva de quando se abster delas.”