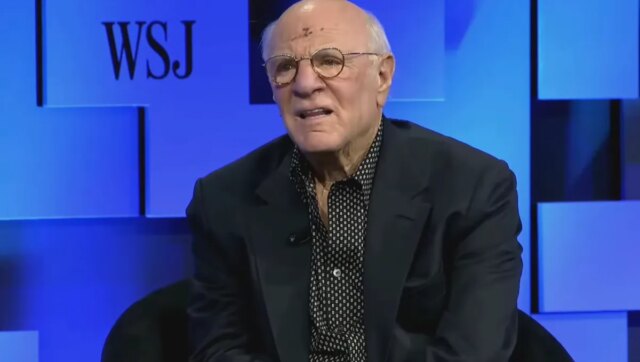

O magnata da mídia bilionário Barry Diller não acha que o CEO da OpenAI, Sam Altman, não seja confiável, apesar relatórios recentes em contrário. No palco da conferência “Futuro de Tudo” do The Wall Avenue Journal esta semana, Diller atestou o executivo de IA, que foi acusado por alguns ex-colegas e membros do conselho de ser às vezes manipulador e enganoso.

Diller, que é amigo de Altman, respondia a uma pergunta sobre se as pessoas deveriam ou não confiar em Altman para garantir que a inteligência synthetic beneficie a humanidade.

Em specific, ele foi questionado sobre a forma teórica de IA conhecida como inteligência synthetic geral, ou AGI, que poderia um dia superar os humanos em qualquer tarefa.

O executivo de mídia, cofundador da Fox Broadcasting e presidente do IAC e do Expedia Group, disse que, embora acredite que Altman é sincero em suas atividades, essa não é realmente a área de preocupação na qual as pessoas deveriam se concentrar. Pelo contrário, são as consequências desconhecidas que resultarão da IA.

“Um dos grandes problemas da IA é que ela vai muito além da confiança”, disse Diller. “Pode ser que a confiança seja irrelevante porque as coisas que estão acontecendo são uma surpresa para as pessoas que estão fazendo essas coisas acontecerem. E passei muito tempo com várias pessoas que estiveram no modo de criação da IA, e elas próprias têm um sentimento de admiração. Então… é o grande desconhecido. Não sabemos. Eles não sabem”, explicou ele.

“Embarcamos em algo que vai mudar quase tudo. Não é subnotificado. Agora, se esses enormes investimentos vão acontecer – eu não poderia me importar menos. Não estou investido nisso, mas progresso será feito”, acrescentou Diller.

Ainda assim, o magnata da comunicação social disse acreditar que a maioria das pessoas que lideram o ataque são bons administradores, dizendo acreditar que Altman é sincero e “uma pessoa decente com bons valores”. (Diller não diria qual dos líderes de IA ele considera falso, devemos observar.)

Evento Techcrunch

São Francisco, Califórnia

|

13 a 15 de outubro de 2026

“Mas a questão não é a administração deles. A questão é… é lidar verdadeiramente com o desconhecido. Eles não sabem o que pode acontecer quando você obtém AGI, e estamos perto disso. Ainda não chegamos lá, mas estamos cada vez mais perto, cada vez mais rápido. E devemos pensar em grades de proteção”, observou Diller.

Além disso, alertou ele, se os humanos não pensarem em grades de proteção, então a alternativa é que “outra força, uma força AGI, fará isso sozinha. E quando isso acontecer, uma vez que você liberar isso, não há como voltar atrás”, disse Diller.

Quando você compra por meio de hyperlinks em nossos artigos, podemos ganhar uma pequena comissão. Isso não afeta nossa independência editorial.