O treinamento de modelos de raciocínio de IA exige recursos que a maioria das equipes empresariais não possui. As equipes de engenharia muitas vezes são forçadas a escolher entre extrair conhecimento de modelos grandes e caros ou confiar em técnicas de aprendizado por reforço que fornecem suggestions escasso.

Pesquisadores do JD.com e de diversas instituições acadêmicas introduziram recentemente um novo paradigma de treinamento que contorna esse dilema. A técnica, chamada Aprendizagem por Reforço com Recompensas Verificáveis com Autodestilação (RLSD), combina o rastreamento confiável do desempenho do aprendizado por reforço com o suggestions granular da autodestilação.

Experimentos indicam que os modelos treinados com RLSD superam aqueles construídos em algoritmos clássicos de destilação e aprendizado por reforço. Para as equipes empresariais, essa abordagem reduz as barreiras técnicas e financeiras para a construção de modelos de raciocínio personalizados, adaptados à lógica de negócios específica.

O problema com modelos de raciocínio de treinamento

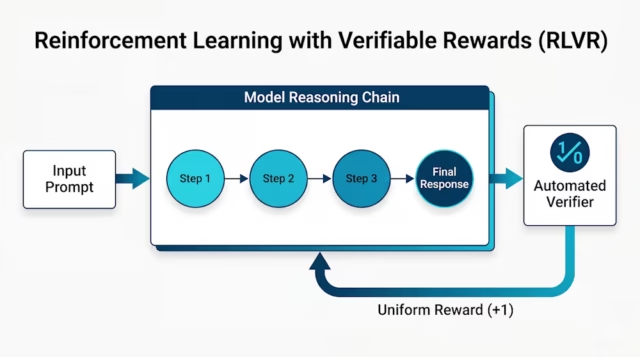

O método padrão para treinar modelos de raciocínio é Aprendizagem por Reforço com Recompensas Verificáveis (RLVR). Neste paradigma, o modelo aprende por tentativa e erro, guiado por um resultado remaining do seu ambiente. Um verificador automatizado verifica se a resposta do modelo está certa ou errada, fornecendo uma recompensa binária, como 0 ou 1.

O RLVR sofre de suggestions esparso e uniforme. “O GRPO padrão tem um problema de densidade de sinal”, disse Chenxu Yang, coautor do artigo, ao VentureBeat. “Um rastreamento de raciocínio com vários milhares de tokens recebe uma única recompensa binária, e cada token dentro desse rastreamento recebe crédito idêntico, seja uma etapa lógica basic ou uma frase descartável.” Consequentemente, o modelo nunca aprende quais etapas intermediárias levaram ao seu sucesso ou fracasso.

A destilação sob política (OPD) adota uma abordagem diferente. Em vez de esperar pelo resultado remaining, os desenvolvedores combinam um modelo de aluno menor com um modelo de professor maior e mais capaz. Para cada exemplo de treinamento, o aluno compara sua resposta com a do professor, ficha por ficha. Isso fornece ao aluno suggestions granular sobre toda a cadeia de raciocínio e processo de geração de respostas.

Implantar e executar um modelo massivo de professor separado junto com o aluno durante todo o processo de treinamento gera uma enorme sobrecarga computacional. “Você precisa manter um modelo de professor maior residente durante todo o treinamento, o que praticamente dobra a área ocupada pela GPU”, disse Yang. Além disso, os modelos de professor e aluno devem compartilhar exatamente a mesma estrutura de vocabulário, o que, de acordo com Yang, “exclui silenciosamente a maioria das configurações de arquitetura cruzada, modalidade cruzada ou multilíngue que as empresas realmente administram”.

A promessa e o fracasso da autodestilação

A autodestilação sob política (OPSD) surgiu como uma solução projetada para superar as deficiências das outras duas abordagens. No OPSD, o mesmo modelo desempenha o papel tanto do aluno quanto do professor.

Durante o treinamento, o aluno recebe um aviso padrão enquanto o professor recebe informações privilegiadas, como uma chave de resposta passo a passo verificada. Essa versão do modelo do professor bem informado avalia a versão do aluno, fornecendo suggestions token por token enquanto o aluno tenta resolver o problema usando apenas o immediate padrão.

O OPSD parece ser o compromisso perfeito para um orçamento empresarial. Ele fornece orientação granular e passo a passo do OPD. Por eliminar a necessidade de um modelo de professor externo, opera com a alta eficiência computacional e o baixo custo do RLVR, exigindo apenas um passe additional para o professor.

No entanto, os pesquisadores descobriram que o OPSD sofre de um fenômeno denominado “vazamento de informações privilegiadas”.

“O objetivo é estruturalmente mal colocado”, disse Yang. “Há uma lacuna irredutível de informação mútua que o aluno nunca pode fechar… Quando a autodestilação é configurada como correspondência de distribuição, o aluno é solicitado a imitar a distribuição completa da produção do professor sob um contexto privilegiado.”

Como o professor avalia o aluno com base em uma chave de resposta oculta, o objetivo do treinamento força o modelo do aluno a aprender as frases ou etapas exatas do professor, em vez da lógica de raciocínio subjacente. Como resultado, o modelo estudante começa a alucinar referências a uma solução invisível à qual não terá acesso numa implementação no mundo actual.

Na prática, os modelos OPSD mostram um rápido aumento no desempenho no início do treino, mas as suas capacidades de raciocínio rapidamente estagnam e degradam-se progressivamente ao longo do tempo.

Desacoplando a direção da magnitude com RLSD

Os pesquisadores por trás do RLSD perceberam que os sinais que governam como um modelo atualiza seus parâmetros têm requisitos fundamentalmente assimétricos. Eles identificaram que o sinal que dita a direção da atualização (ou seja, se deve reforçar ou penalizar um comportamento) pode ser esparso, mas deve ser perfeitamente confiável, porque apontar o modelo na direção errada prejudica a sua política de raciocínio.

Por outro lado, o sinal que determina a magnitude da atualização (ou seja, quanto crédito relativo ou culpa merece uma etapa específica) beneficia de ser extremamente denso para permitir correções passo a passo refinadas.

O RLSD baseia-se neste princípio, dissociando a direção da atualização da magnitude da atualização. A estrutura permite que o suggestions ambiental verificável do sinal RLVR decide estritamente a direção do aprendizado. O modelo só recebe reforço international se a resposta remaining for objetivamente correta.

O autodidata é despojado do poder de ditar o que o modelo deve gerar. Em vez disso, a avaliação do professor, ficha por ficha, é reaproveitada para determinar a magnitude da atualização. Simplesmente distribui o crédito ou a culpa whole pelas etapas individuais do caminho de raciocínio do modelo.

Isso altera a forma como o modelo aprende em comparação com o paradigma OPSD clássico. No OPSD padrão, o objetivo do treinamento atua como uma clonagem comportamental, onde o modelo é forçado a copiar diretamente as palavras e frases exatas do professor. Isso faz com que o aluno tenha alucinações e vaze referências a dados que não possui.

Em vez de forçar o modelo a copiar uma solução oculta, o RLSD fornece uma fonte pure e praticamente gratuita de informações de crédito por token.

“A intuição: não estamos ensinando o modelo a raciocinar como o professor”, disse Yang. “Estamos dizendo ao modelo, no caminho que ele escolheu, quais dos seus próprios tokens estavam realmente fazendo o trabalho. A distribuição de exploração do modelo permanece a mesma. Apenas a alocação de crédito é aprimorada.”

Se uma dedução específica apoia fortemente o resultado correto, recebe uma pontuação mais elevada. Se for apenas uma palavra de preenchimento inútil, ela receberá uma pontuação básica. O RLSD elimina a necessidade de treinar redes auxiliares complexas de recompensa, anotar manualmente dados passo a passo ou manter modelos externos massivos de professores.

Colocando o RLSD à prova

Para testar o RLSD, os pesquisadores treinaram o modelo de linguagem de visão Qwen3-VL-8B de peso aberto e o avaliaram em vários benchmarks de raciocínio visible. Estes incluíram MMMU para questões multidisciplinares de nível universitário, MathVista, MathVision, WeMath e ZeroBench, um benchmark de teste de estresse explicitamente projetado para ser quase impossível para os atuais modelos de fronteira.

Eles compararam o modelo RLSD com o modelo básico sem pós-treinamento, RLVR padrão por meio do algoritmo GRPO, OPSD padrão e uma combinação híbrida dos dois.

O RLSD superou significativamente todos os outros métodos, alcançando a maior precisão média de 56,18% em todos os cinco benchmarks. Ele superou o modelo básico em 4,69% e superou o RLVR padrão em 2,32%. Os ganhos foram mais pronunciados em tarefas complexas de raciocínio matemático, onde o RLSD superou o RLVR padrão em 3,91% no benchmark MathVision.

Além da precisão, a estrutura oferece enormes ganhos de eficiência. “Concretamente, o RLSD em 200 etapas de treinamento já supera o GRPO treinado para 400 etapas, portanto, uma aceleração de convergência de aproximadamente 2x”, disse Yang. “Em termos de custo, a única sobrecarga além de um pipeline GRPO regular é uma passagem additional por resposta para obter logits do professor. Em comparação com a geração de implementação… isso é basicamente gratuito.”

Ao contrário do OPSD, que viu o desempenho aumentar e depois entrou em colapso whole devido ao vazamento de informações, o RLSD manteve a estabilidade do treinamento a longo prazo e convergiu para um teto de desempenho mais elevado do que os métodos padrão.

As descobertas qualitativas destacam como o modelo altera seu comportamento de aprendizagem. Por exemplo, em uma tarefa complexa de contagem visible, o RLVR padrão analisa a resposta correta remaining e dá a mesma recompensa ao parágrafo inteiro de tokens de raciocínio. O RLSD aplicou recompensas cirurgicamente às etapas específicas de subtração matemática que resolveram o problema, enquanto reduzia ativamente o texto de preenchimento genérico como “Olhando para a imagem, vejo…”.

Em outro exemplo, o modelo executou uma derivação matemática incorreta com base em um gráfico de barras. Em vez de rotular toda a resposta como um fracasso, o RLSD concentrou a penalidade mais pesada no ponto exato onde o modelo interpretou mal uma relação do gráfico. Permaneceu neutro no resto da configuração lógica, reconhecendo que a estrutura inicial period válida.

Isso é particularmente importante para casos de uso corporativos complicados e reais. Se um modelo cometer um erro ao analisar um relatório de lucros trimestrais de 50 páginas, os desenvolvedores não querem que ele desapreenda toda a sua estrutura analítica. Eles só querem corrigir a suposição específica que errou. O RLSD permite que o modelo aprenda exatamente quais saltos lógicos são valiosos e quais são falhos, token por token. Como o RLSD faz isso reaproveitando o próprio modelo, ele fornece modelos com recursos de raciocínio granular, ao mesmo tempo que mantém razoáveis os custos de treinamento.

Como as empresas podem começar

Para engenheiros de dados e equipes de orquestração de IA, a integração do RLSD é simples, mas requer a configuração correta. O requisito mais crítico é um sinal de recompensa verificável, como compiladores de código, verificadores matemáticos, execução de SQL ou validadores de esquema. “Tarefas sem recompensa verificável (diálogo aberto, escrita da voz da marca) pertencem a pipelines baseados em preferências”, disse Yang.

No entanto, o RLSD é altamente flexível em relação às informações privilegiadas que necessita. Embora o OPSD exija estruturalmente traços de raciocínio intermediários completos, forçando as empresas a pagar anotadores ou a extrair de um modelo de fronteira, o RLSD não o faz.

“Se você tiver traços de raciocínio verificados completos, ótimo, o RLSD irá usá-los”, disse Yang. “Se tudo o que você tem é a resposta remaining verdadeira, isso também funciona… O OPSD não tem essa flexibilidade.”

Integrar a técnica em estruturas RL multimodais de código aberto existentes, como veRL ou EasyR1, é incrivelmente leve. De acordo com Yang, não requer reescrita da estrutura e é inserida diretamente na pilha padrão. A troca de código envolve simplesmente alterar dezenas de linhas para ajustar o objetivo do GRPO e sincronizar o professor com o aluno.

Olhando para o futuro, o RLSD oferece uma forma poderosa para as empresas maximizarem os seus ativos internos existentes.

“Os dados proprietários que as empresas mantêm dentro de seu perímetro (manuais de conformidade, documentação interna, tickets históricos, trechos de código verificados) são essencialmente informações privilegiadas gratuitas”, concluiu Yang. “O RLSD permite que as empresas alimentem esse tipo de dados diretamente em um contexto privilegiado, o que aprimora o sinal de aprendizagem em modelos menores, sem precisar de um professor externo e sem enviar nada para fora da rede.”