A categoria de banco de dados vetorial está passando por uma mudança em resposta às necessidades da IA agente.

O pipeline de geração aumentada de recuperação (RAG) para banco de dados vetorial não funciona mais; A IA agente requer uma abordagem diferente que incorpore o contexto. Pulso do primeiro trimestre de 2026 da VentureBeat A pesquisa ressalta essa tendência: todo banco de dados de vetores autônomo está perdendo parcela de adoção, enquanto a intenção de recuperação híbrida triplicou para 33,3%, a posição estratégica de crescimento mais rápido no conjunto de dados.

A pioneira em banco de dados vetorial, Pinecone, reconhece isso e está se esforçando para atender às necessidades específicas da IA agente.

A empresa anunciou hoje o Nexus, que posiciona mais como um mecanismo de conhecimento do que como uma melhoria na recuperação. O Nexus apresenta um compilador de contexto que converte dados empresariais brutos em artefatos de conhecimento persistentes e específicos de tarefas antes que os agentes os consultem, e um recuperador combinável que fornece a esses artefatos citações em nível de campo e resolução determinística de conflitos.

Juntamente com o Nexus, a Pinecone está lançando o KnowQL, uma linguagem de consulta declarativa que fornece aos agentes um vocabulário para especificar o formato da saída, os requisitos de confiança e os orçamentos de latência. No próprio benchmark interno da Pinecone, uma tarefa de análise financeira que anteriormente consumia 2,8 milhões de tokens foi concluída pela Nexus com apenas 4.000. Isto representa uma redução de 98%, embora a empresa ainda não tenha validado isso nas implantações de produção do cliente. Nexus está em acesso antecipado a partir de hoje.

“O RAG foi construído para usuários humanos”, disse Ash Ashutosh, CEO da Pinecone, ao VentureBeat. “O Nexus foi construído para usuários agentes, porque sua linguagem é muito diferente. As respostas que eles esperam são muito diferentes. A tarefa atribuída a um agente é muito diferente daquela que um chatbot deve fazer.”

Por que o RAG nunca foi construído para o que os agentes realmente fazem

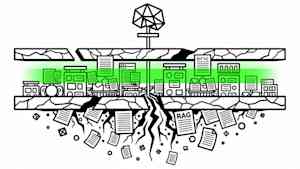

O RAG abrange uma consulta, uma resposta e uma pessoa envolvida para interpretar o resultado. Mas os agentes trabalham de forma diferente. A eles são atribuídas tarefas, não perguntas — e concluí-las requer reunir contexto de múltiplas fontes, resolver conflitos, rastrear o que já foi recuperado e decidir o que consultar em seguida.

A distinção é importante. Um pipeline RAG recupera documentos e os entrega a um modelo no momento da inferência. Cada sessão do agente começa fria, sem nenhum entendimento compilado do patrimônio de dados corporativos — quais tabelas estão relacionadas a quais, quais fontes são autorizadas para quais perguntas e quais formatos um agente downstream poderá realmente consumir. Cada sessão redescobre isso do zero.

“No centro de tudo isso estava um problema muito simples”, disse Ashutosh. “Você está pedindo aos agentes – máquinas – que trabalhem em sistemas e dados que foram projetados para humanos.”

A Pinecone estima que 85% do esforço computacional do agente vai para o ciclo de redescoberta, e não para a conclusão da tarefa. Os efeitos posteriores são compostos: latência imprevisível, custos excessivos de token e resultados não determinísticos. Execute a mesma tarefa duas vezes com os mesmos dados e um agente poderá retornar respostas diferentes sem nenhum registro de quais fontes geraram qualquer resultado. Para empresas onde a auditabilidade é um requisito de conformidade, isso é um desqualificador estrutural e não um problema de ajuste.

O que é Nexus e como funciona

O Nexus transfer o trabalho de raciocínio do tempo de inferência para o tempo de compilação. Em um pipeline RAG convencional, o raciocínio necessário para interpretar, contextualizar e estruturar o conhecimento acontece no momento em que um agente consulta – a cada sessão, a cada vez, queimando tokens no trabalho que poderia ter sido feito antecipadamente. Mas o Nexus raciocina apenas uma vez durante um estágio de compilação que é executado antes de qualquer consulta do agente e depois armazena o resultado como um artefato de conhecimento reutilizável. O agente recebe contexto estruturado e pronto para tarefas, em vez de documentos brutos para interpretação imediata.

A arquitetura que a Pinecone está enviando tem três componentes distintos, cada um abordando uma camada diferente do problema de recuperação do agente.

-

Compilador de contexto. O Nexus utiliza dados brutos de origem e uma especificação de tarefa e cria artefatos de conhecimento especializados — representações estruturadas e otimizadas para tarefas que os agentes consomem diretamente, sem sobrecarga de interpretação. O mesmo conjunto de dados subjacente produz artefatos diferentes para agentes diferentes: um agente de vendas obtém o contexto do negócio sintetizado a partir do CRM e dos registros de chamadas, um agente financeiro obtém o contexto da receita vinculando contratos a programações de faturamento. Os artefatos são persistentes e reutilizados nas sessões do agente, não regenerados no momento da inferência.

-

Recuperador combinável. Os artefatos compilados são servidos no momento da consulta com campos digitados, citações por campo com níveis de confiança e resolução determinística de conflitos. A saída é moldada para corresponder ao formato especificado do agente, em vez de ser retornada como texto bruto para o agente analisar novamente.

-

ConheçaQL. Pinecone descreve isso como a primeira linguagem de consulta declarativa projetada para agentes e não para humanos. Seis primitivas — intenção, filtro, proveniência, formato de saída, confiança e orçamento — permitem que os agentes especifiquem respostas estruturadas e envelopes de aterramento e latência de origem em uma única interface. Ashutosh comparou a lacuna estrutural que o KnowQL preenche com o que o SQL fez para os bancos de dados relacionais: antes de existir uma interface padrão, cada aplicativo construía sua própria camada de acesso a dados do zero.

A relação entre o banco de dados vetorial subjacente do Nexus e do Pinecone é aditiva. O compilador de contexto produz artefatos de conhecimento que são indexados e armazenados no banco de dados vetorial; a camada de compilação molda e serve o conhecimento; a camada vetorial lida com armazenamento, velocidade de recuperação e escala.

“Os vetores ainda são armazenados e gerenciados pelo banco de dados de vetores Pinecone”, disse Ashutosh.

O que os analistas acham da afirmação arquitetônica

Mover o raciocínio a montante, da inferência para um estágio de compilação, não é um conceito novo – ontologias, catálogos de dados e camadas semânticas têm buscado versões dele há anos. O que mudou foi a capacidade de fazer isso em escala, sem equipes de engenharia dedicadas para cada domínio. Esse é o argumento específico que a Nexus está apresentando, e é onde os analistas veem o avanço genuíno.

Stephanie Walter, líder prática de pilha de IA na HyperFRAME Analysis, disse à VentureBeat que o Nexus é direcionalmente importante porque muda o trabalho de conhecimento do caos do tempo de execução para a estrutura pré-compilada. Ela ressaltou, porém, que se trata de uma evolução da arquitetura RAG, e não de uma reinvenção completa.

“A verdadeira inovação não é a ideia em si, mas a produção da compilação de conhecimento como uma camada de infraestrutura de primeira classe”, disse Walter. “Se a Pinecone puder operacionalizar isso de forma confiável, ela se tornará uma infraestrutura significativa, e não apenas mais um truque de ajuste do RAG.”

O mecanismo técnico por trás dessa afirmação é o que o analista VP do Gartner, Arun Chandrasekaran, chamou de distinção arquitetural significativa. “Ao contrário do RAG tradicional, que depende de pesquisa semântica pura em tempo de execução, a compilação arquitetônica incorpora lógica estrutural na camada de metadados, o que pode aumentar o tempo de resposta e fornecer melhor raciocínio”, disse Chandrasekaran ao VentureBeat. “Este é um salto importante da recuperação simples para o raciocínio aprimorado, permitindo que os agentes naveguem nos esquemas corporativos e adquiram melhor memória para contextualização”.

O cenário competitivo

Vários fornecedores reconhecem que um banco de dados vetorial e um RAG tradicional não são suficientes para a IA agente.

A Microsoft estendeu seu Tecnologia FabricIQ para fornecer contexto semântico para IA agente. O Google anunciou recentemente seu Nuvem de dados agentes como uma abordagem para ajudar a resolver os mesmos problemas. Existem também tecnologias autônomas de memória contextual, como retrospectivaque oferecem mais uma opção para os usuários.

Mas umos analistas estão menos focados na comparação de recursos do que no que os compradores deveriam realmente avaliar. “A pilha de IA agente está se fragmentando em dezenas de recursos, mas os compradores corporativos não deveriam perseguir recursos”, disse Walter. “Eles deveriam perseguir o controle: controle de custos, controle de governança e controle de segurança.”

A maioria das falhas empresariais na IA de agência, argumentou ela, não será técnica. Serão operacionais – ligados a custos excessivos, lacunas de governação e disciplina de segurança.

A barra de capacidade vai além da velocidade de recuperação. “O verdadeiro diferenciador é a base determinística”, disse Chandrasekaran, apontando para técnicas como gráficos de conhecimento que garantem que os agentes entendam as relações estruturais dentro dos dados corporativos, em vez de retornar correspondências de nível superficial. A interoperabilidade é uma consideração relacionada: padrões como o protocolo de contexto de modelo (MCP) são importantes para conectar agentes a fontes de dados legadas sem criar novas dependências.

O que isso significa para as empresas

Os bancos de dados vetoriais independentes e RAG foram construídos para uma period diferente. As cargas de trabalho agênticas estão expondo os limites de ambos.

O problema do custo de recuperação é arquitetônico

As equipes que executam cargas de trabalho complexas em pipelines RAG convencionais estão queimando tokens no momento da inferência sobre o trabalho que poderia ser feito antecipadamente – interpretando, contextualizando e estruturando o conhecimento, em cada sessão, do zero. Esse é um problema de design. Ajustar a camada de recuperação não resolverá o problema. A questão para as equipes de engenharia de dados é se sua pilha atual é estruturalmente capaz de pré-compilar conhecimento para tarefas específicas do agente ou se foi construída para um usuário humano que nunca precisou dessa capacidade.

Governança é o que separa uma implantação piloto de uma implantação de produção

Os recursos que determinam se a IA de agência será aprovada para uso empresarial não são métricas de desempenho.

“A verdadeira proposta de valor empresarial não é apenas uma recuperação mais rápida, mas também canais de conhecimento governados”, disse Walter. “Essas são as capacidades que transformam a IA de agente de um experimento em algo que as equipes de finanças e risco realmente aprovarão.”

O orçamento mudou

Os dados Q1 Pulse da VentureBeat mostram que o investimento em otimização de recuperação aumentou para 28,9% em março, ultrapassando os gastos com avaliação pela primeira vez no trimestre. As empresas terminaram de medir seus problemas de recuperação. Eles agora estão gastando para consertá-los.

“O futuro da IA agente não será decidido por quem tem a janela de contexto mais longa”, disse Walter. “Será decidido por quem pode operacionalizar o conhecimento confiável em escala sem aumentar os custos ou a governança”.