Quatro palestras separadas do RSAC 2026 chegaram à mesma conclusão sem coordenação. Vasu Jakkal, da Microsoft, disse aos participantes que a confiança zero deve se estender à IA. Jeetu Patel, da Cisco, pediu uma mudança do controle de acesso para o controle de ação, dizendo em uma entrevista exclusiva à VentureBeat que os agentes se comportam “mais como adolescentes, extremamente inteligentes, mas sem medo das consequências”. George Kurtz, da CrowdStrike, identificou a governança da IA como a maior lacuna na tecnologia empresarial. John Morgan, do Splunk, pediu um modelo de governança e confiança de agente. Quatro empresas. Quatro etapas. Um problema.

Matt Caulfield, vice-presidente de produto de identidade e duo da Cisco, foi direto em uma entrevista exclusiva da VentureBeat na RSAC. “Embora o conceito de confiança zero seja bom, precisamos dar um passo adiante”, disse Caulfield. “Não se trata apenas de autenticar uma vez e depois deixar o agente correr solto. Trata-se de verificar e examinar continuamente cada ação que o agente está tentando realizar, porque a qualquer momento esse agente pode se tornar desonesto.”

Setenta e nove por cento das organizações já usam agentes de IA, de acordo com Pesquisa de agentes de IA de 2025 da PwC. Apenas 14,4% relataram aprovação whole de segurança para toda a sua frota de agentes, de acordo com o Relatório Gravitee State of AI Agent Security 2026 de 919 organizações em fevereiro de 2026. Um Pesquisa CSA apresentado no RSAC descobriu que apenas 26% têm políticas de governança de IA. Estrutura Agentic Trust da CSA descreve a lacuna resultante entre a velocidade de implantação e a prontidão da segurança como uma emergência de governança.

Os líderes de segurança cibernética e executivos do setor da RSAC concordaram com o problema. Então, duas empresas lançaram arquiteturas que respondem à pergunta de maneira diferente. A lacuna entre seus designs revela onde está o risco actual.

O problema do agente monolítico que as equipes de segurança estão herdando

O padrão de agente corporativo padrão é um contêiner monolítico. O modelo raciocina, chama ferramentas, executa o código gerado e mantém credenciais em um processo. Cada componente confia em todos os outros componentes. Tokens OAuth, chaves de API e credenciais git ficam no mesmo ambiente onde o agente executa o código que escreveu segundos atrás.

Uma injeção imediata dá tudo ao invasor. Os tokens podem ser exfiltrados. As sessões podem ser geradas. O raio da explosão não é o agente. É todo o contêiner e todos os serviços conectados.

O Pesquisa CSA e Aembit de 228 profissionais de TI e segurança quantifica o quão comum isso permanece: 43% usam contas de serviços compartilhados para agentes, 52% confiam em identidades de carga de trabalho em vez de credenciais específicas do agente, e 68% não conseguem distinguir a atividade do agente da atividade humana em seus logs. Nenhuma função reivindicou a propriedade do acesso do agente de IA. A segurança disse que period responsabilidade do desenvolvedor. Os desenvolvedores disseram que period uma responsabilidade de segurança. Ninguém period dono disso.

Elia Zaitsev, CTO da CrowdStrike, em uma entrevista exclusiva da VentureBeat, disse que o padrão deve parecer acquainted. “Muito da aparência dos agentes de segurança seria muito semelhante à aparência de usuários altamente privilegiados. Eles têm identidades, têm acesso a sistemas subjacentes, raciocinam e agem”, disse Zaitsev. “Raramente haverá uma solução única que seja a solução mágica. É uma estratégia de defesa em profundidade.”

O CEO da CrowdStrike, George Kurtz, destacou ClawHavoc (uma campanha da cadeia de suprimentos voltada para a estrutura de agente OpenClaw) no RSAC durante sua palestra. Segurança Koi nomeou a campanha em 1º de fevereiro de 2026. Antiy CERT confirmou 1.184 habilidades maliciosas vinculadas a 12 contas de editores, de acordo com múltiplo análises independentes da campanha. Pesquisa ToxicSkills de Snyk descobriram que 36,8% das 3.984 habilidades do ClawHub verificadas contêm falhas de segurança em qualquer nível de gravidade, com 13,4% classificadas como críticas. O tempo médio de intervalo caiu para 29 minutos. Mais rápido observado: 27 segundos. (Relatório de ameaças globais CrowdStrike 2026)

Antrópico separa o cérebro das mãos

Agentes Gerenciados da Anthropiclançado em 8 de abril em versão beta pública, divide cada agente em três componentes que não confiam um no outro: um cérebro (Claude e o chicote roteando suas decisões), mãos (contêineres Linux descartáveis onde o código é executado) e uma sessão (um log de eventos somente anexado fora de ambos).

Separar as instruções da execução é um dos padrões mais antigos do software program. Microsserviços, funções sem servidor e filas de mensagens.

As credenciais nunca entram na sandbox. A Anthropic armazena tokens OAuth em um cofre externo. Quando o agente precisa chamar uma ferramenta MCP, ele envia um token vinculado à sessão para um proxy dedicado. O proxy busca credenciais reais do cofre, faz a chamada externa e retorna o resultado. O agente nunca vê o token actual. Os tokens Git são conectados ao controle remoto native na inicialização do sandbox. Trabalho push e pull sem que o agente toque na credencial. Para os diretores de segurança, isso significa que uma sandbox comprometida não produz nada que um invasor possa reutilizar.

O ganho de segurança chegou como efeito colateral de uma correção de desempenho. A Anthropic separou o cérebro das mãos para que a inferência pudesse começar antes que o contêiner fosse inicializado. Tempo médio para o primeiro token caiu cerca de 60%. O design de confiança zero também é o design mais rápido. Isso acaba com a objeção corporativa de que a segurança adiciona latência.

A durabilidade da sessão é o terceiro ganho estrutural. Uma falha de contêiner no padrão monolítico significa perda whole de estado. Nos Agentes Gerenciados, o log da sessão persiste fora do cérebro e das mãos. Se o chicote falhar, um novo será inicializado, lerá o log de eventos e continuará. Nenhuma perda de estado se transforma em ganho de produtividade ao longo do tempo. Os Agentes Gerenciados incluem rastreamento de sessão integrado por meio do Claude Consola.

Preço: US$ 0,08 por hora de sessão de tempo de execução ativo, excluindo tempo ocioso, mais custos de token de API padrão. Os diretores de segurança agora podem modelar o custo de comprometimento do agente por hora de sessão em relação ao custo dos controles arquitetônicos.

A Nvidia bloqueia a sandbox e monitora tudo dentro dela

NemoClaw da Nvidialançado em 16 de março na pré-visualização, adota a abordagem oposta. Não separa o agente do seu ambiente de execução. Ele envolve todo o agente em quatro camadas de segurança empilhadas e observa cada movimento. Anthropic e Nvidia são os únicos dois fornecedores que lançaram publicamente arquiteturas de agentes de confiança zero até o momento em que este livro foi escrito; outros estão em desenvolvimento.

O NemoClaw empilha cinco camadas de aplicação entre o agente e o host. A execução em sandbox usa Landlock, seccomp e isolamento de namespace de rede no nível do kernel. A rede de saída com negação padrão força todas as conexões externas por meio da aprovação explícita do operador by way of Política baseada em YAML. O acesso é executado com privilégios mínimos. Um roteador de privacidade direciona consultas confidenciais para modelos Nemotron executados localmente, reduzindo a zero o custo de token e o vazamento de dados. A camada que mais importa para as equipes de segurança é a verificação de intenções: o mecanismo de política do OpenShell intercepta cada ação do agente antes que ela atinja o host. A compensação para as organizações que avaliam o NemoClaw é direta. Maior visibilidade do tempo de execução custa mais pessoal do operador.

O agente não sabe que está dentro do NemoClaw. As ações dentro da política retornam normalmente. Ações fora da política recebem uma negação configurável.

A observabilidade é a camada mais forte. Uma interface de usuário de terminal em tempo actual registra cada ação, cada solicitação de rede, cada conexão bloqueada. A trilha de auditoria está completa. O problema é o custo: a carga do operador aumenta linearmente com a atividade do agente. Cada novo endpoint requer aprovação handbook. A qualidade da observação é alta. A autonomia é baixa. Essa proporção fica cara rapidamente em ambientes de produção que executam dezenas de agentes.

Durabilidade é a lacuna de que ninguém fala. O estado do agente persiste como arquivos dentro do sandbox. Se a sandbox falhar, o estado irá junto. Não existe nenhum mecanismo externo de recuperação de sessão. As tarefas de agente de longa duração acarretam um risco de durabilidade que as equipes de segurança precisam avaliar no planejamento da implantação antes de entrarem em produção.

A lacuna de proximidade de credenciais

Ambas as arquiteturas são um verdadeiro avanço em relação ao padrão monolítico. Onde elas divergem está a questão que mais importa para as equipes de segurança: quão próximas as credenciais ficam do ambiente de execução?

Antrópico take away totalmente as credenciais do raio de explosão. Se um invasor comprometer a sandbox por meio de injeção imediata, ele obterá um contêiner descartável sem tokens e sem estado persistente. A exfiltração de credenciais requer um ataque de dois saltos: influenciar o raciocínio do cérebro e, em seguida, convencê-lo a agir através de um contêiner que não contém nada que valha a pena roubar. A exfiltração de salto único é estruturalmente eliminada.

O NemoClaw restringe o raio da explosão e monitora cada ação dentro dele. Quatro camadas de segurança limitam o movimento lateral. A rede de negação padrão bloqueia conexões não autorizadas. Mas o agente e o código gerado compartilham a mesma sandbox. O roteador de privacidade da Nvidia mantém credenciais de inferência no host, fora da sandbox. Mas os tokens de mensagens e integração (Telegram, Slack, Discord) são injetados na sandbox como variáveis de ambiente de tempo de execução. As chaves da API de inferência são proxy por meio do roteador de privacidade e não são passadas diretamente para a sandbox. A exposição varia de acordo com o tipo de credencial. As credenciais são controladas por políticas e não são removidas estruturalmente.

Essa distinção é mais importante para a injeção imediata indireta, em que um adversário incorpora instruções no conteúdo que o agente consulta como parte do trabalho legítimo. Uma página da internet envenenada. Uma resposta de API manipulada. A camada de verificação de intenção avalia o que o agente se propõe a fazer, e não o conteúdo dos dados retornados por ferramentas externas. As instruções injetadas entram na cadeia de raciocínio como um contexto confiável. Com proximidade à execução.

Na arquitetura antrópica, a injeção indireta pode influenciar o raciocínio, mas não pode atingir o cofre de credenciais. Na arquitetura NemoClaw, o contexto injetado fica próximo ao raciocínio e à execução dentro da sandbox compartilhada. Essa é a maior lacuna entre os dois designs.

David Brauchler do Grupo NCC, Diretor Técnico e Chefe de Segurança de IA/ML, defensores de arquiteturas de agentes fechados construído em princípios de segmentação de confiança onde os sistemas de IA herdam o nível de confiança dos dados que processam. Entrada não confiável, recursos restritos. Tanto a Antrópica quanto a Nvidia caminham nessa direção. Nenhum dos dois chega totalmente.

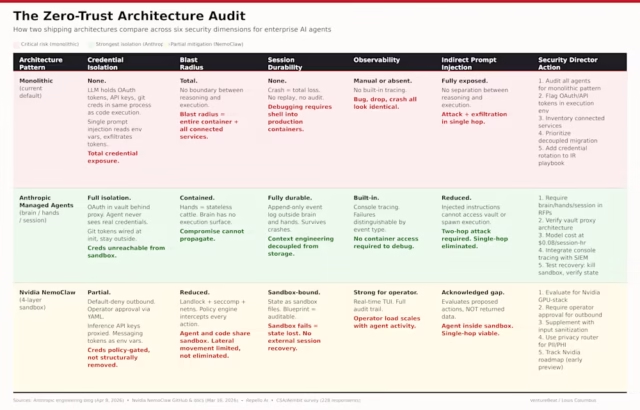

A auditoria de arquitetura de confiança zero para agentes de IA

A grade de auditoria abrange três padrões de fornecedores em seis dimensões de segurança, cinco ações por linha. Ele se resume em cinco prioridades:

-

Audite cada agente implantado para o padrão monolítico. Sinalize qualquer agente que possua tokens OAuth em seu ambiente de execução. O Dados CSA mostra que 43% usam contas de serviços compartilhados. Esses são os primeiros alvos.

-

Exigir isolamento de credenciais em RFPs de implantação de agentes. Especifique se o fornecedor take away as credenciais estruturalmente ou as protege por meio de políticas. Ambos reduzem o risco. Eles o reduzem em quantidades diferentes com diferentes modos de falha.

-

Recuperação da sessão de teste antes da produção. Mate um sandbox no meio da tarefa. Verifique se o estado sobrevive. Caso contrário, o trabalho de longo horizonte acarreta um risco de perda de dados que aumenta com a duração da tarefa.

-

Equipe para o modelo de observabilidade. O rastreamento do console da Anthropic integra-se aos fluxos de trabalho de observabilidade existentes. A TUI do NemoClaw requer um operador no circuito. A matemática do pessoal é diferente.

-

Rastreie roteiros de injeção indireta imediata. Nenhuma das arquiteturas resolve totalmente esse vetor. Antrópico limita o raio de explosão de uma injeção bem-sucedida. O NemoClaw captura ações propostas maliciosas, mas não dados retornados maliciosos. Exija compromissos do fornecedor sobre esta lacuna específica.

A confiança zero para agentes de IA deixou de ser um tópico de pesquisa no momento em que duas arquiteturas foram lançadas. A inadimplência monolítica é um passivo. A lacuna de 65 pontos entre a velocidade de implantação e a aprovação de segurança é onde a próxima classe de violações começará.